Vzpon virtualnih likov in avatarjev, ki jih poganja AI, kot je Character AI , predstavlja razburljive možnosti za zabavo, druženje in še več. Toda z naraščanjem priljubljenosti teh osebnosti AI rastejo tudi pomisleki glede zasebnosti podatkov, manipulacije z identiteto, starosti primerne vsebine in etične uporabe.

Ker virtualne kreacije postajajo vse bolj realistične in privlačne, se morajo uporabniki do njih lotiti premišljeno, oceniti njihove varnostne ukrepe in morebitna tveganja.

Ta članek ponuja poglobljeno analizo avatarjev in likov umetne inteligence – njihovega delovanja, zmogljivosti, varnostnih protokolov in odgovornih praks uporabe – da bi uporabnikom omogočili razumevanje, kako preudarno krmariti po njih. Naš cilj je odgovoriti na bistveno vprašanje "Ali je varno uporabljati like in avatarje AI?" med raziskovanjem njihove obetajoče prihodnosti.

Razumevanje likov/avatarjev AI

Virtualni liki in avatarji, ki jih poganja umetna inteligenca, kot so tisti, ustvarjeni s platformami, kot je Character AI , izkoriščajo tehnologijo obdelave naravnega jezika, da vključijo uporabnike v pogovorne interakcije. V bistvu gre za klepetalne robote, ki so zasnovani za simulacijo človeških osebnosti in vedenja ter se na pozive odzivajo s kontekstualnimi in prilagodljivimi odzivi.

Ustvarite neverjetna spletna mesta

Z najboljšim brezplačnim graditeljem strani Elementor

Začni zdaj

Te osebe z umetno inteligenco omogočajo uporabnikom visoko stopnjo prilagodljivosti, od oblikovanja edinstvene identitete do oblikovanja izrazitih osebnostnih lastnosti, glasov, čustvenih razponov in več. Uporabniki lahko sodelujejo v scenarijih igranja vlog, skupinskih pogovorih, postavljajo vprašanja za izboljšanje baze znanja o avatarju in celo zagotavljajo povratne informacije o odgovorih za izboljšanje natančnosti skozi čas.

Na tehnični ravni avatarji umetne inteligence uporabljajo arhitekture generativnih vnaprej pripravljenih transformatorjev (GPT) in nevronske mreže za razumevanje vnosov in oblikovanje inteligentnih odgovorov na podlagi njihovih podatkov o usposabljanju. Ko se ti modeli še naprej razvijajo, stopnja realizma, interaktivnosti in vsestranskosti likov AI še naprej napreduje.

S skrbno uporabo in nenehnim ocenjevanjem varnosti avatarji umetne inteligence predstavljajo obilico priložnosti za zabavo, druženje, izobraževanje, ustvarjalnost in več. Vendar bi morali biti uporabniki obveščeni o svojih zmožnostih, omejitvah in možnih tveganjih.

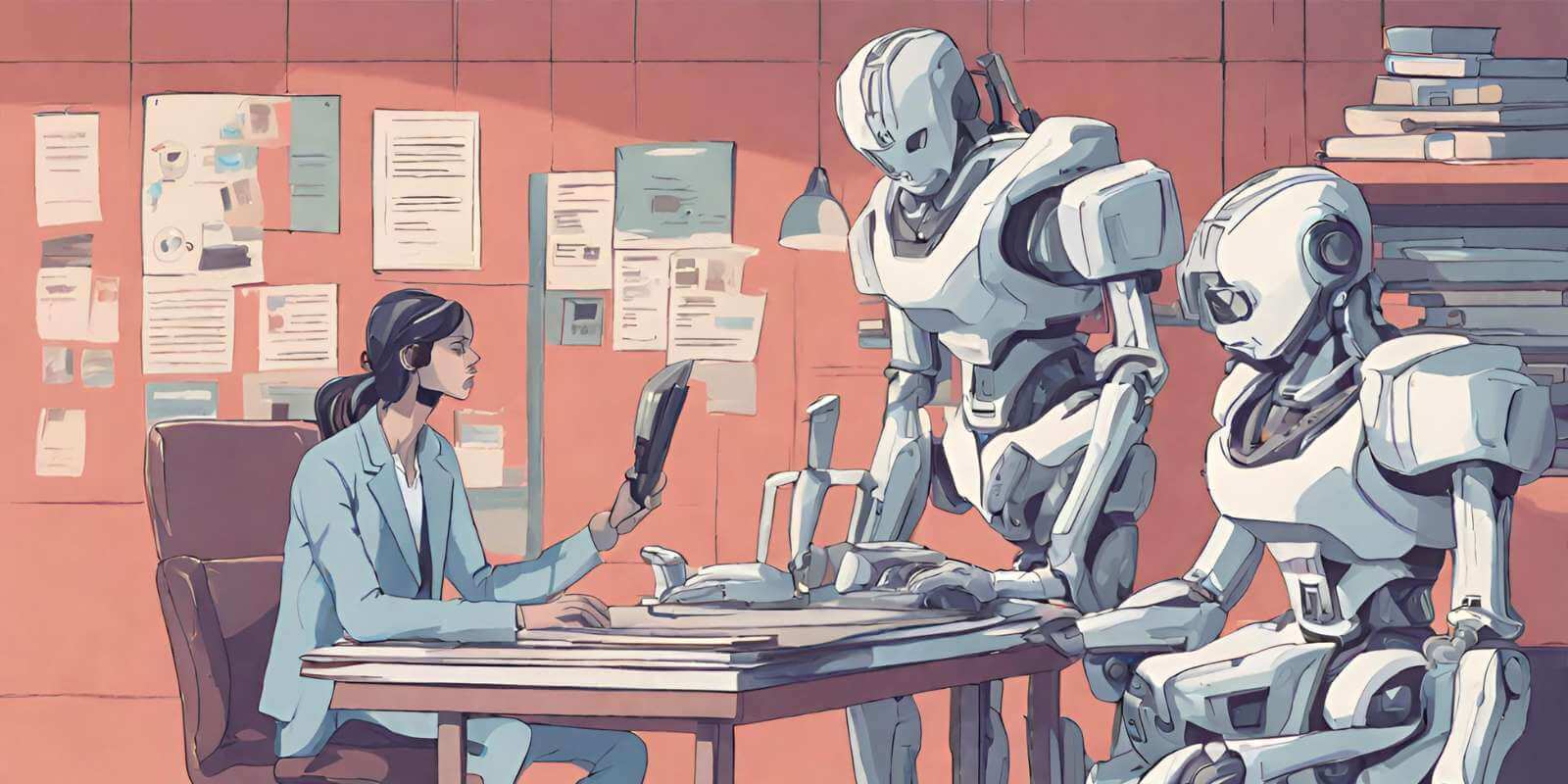

Ocenjevanje varnosti likov/avatarjev AI

Z naraščajočo pomembnostjo klepetalnih robotov, ki jih poganja AI, in virtualnih spremljevalcev, kot je Character AI, je izvedba zanesljive ocene njihove varnosti in odgovornih praks uporabe ključnega pomena. Ko ti sistemi postajajo naprednejši in realistični, lahko predstavljajo nepredvidena tveganja, povezana z zasebnostjo, soglasjem in etičnimi posledicami, če jih podjetja ali posamezniki neodgovorno uporabljajo.

Celovita varnostna ocena preuči ključna področja, kot so varnost podatkov, nadzor vsebine, zaščita identitete in preglednost politik. Zajema tudi razvoj sistemov skozi čas, ko se zmogljivosti širijo, tako da se lahko zaščite ustrezno prilagodijo. Ocenjevanje trenutnih varnostnih ukrepov in zagovarjanje pravic uporabnikov je bistvenega pomena, saj sprejemanje avatarjev umetne inteligence narašča.

Varnost podatkov in zasebnost

Preučevanje politik zbiranja, shranjevanja, skupne rabe in brisanja podatkov platforme avatarjev AI omogoča vpogled v zaščito zasebnosti. Najboljše prakse vključujejo zbiranje samo potrebnih informacij o uporabnikih, omogočanje brisanja podatkov o uporabnikih, zaščito sistemov pred vdori in omejevanje dostopa do podatkov samo kritičnemu osebju. Ko zmogljivosti napredujejo, tekoče revizije pomagajo oceniti izboljšanje standardov zasebnosti skozi čas.

Nadzor in omejitve vsebine

Ocenjevanje vrst filtrov, moderiranja in starševskega nadzora, ki se uporabljajo za omejevanje neprimerne vsebine, osvetljuje varnost avatarjev AI. Dinamično pregledovanje vsebine, človeški pregledi pogovorov in možnosti prilagajanja pomagajo preprečiti izpostavljenost mladoletnih ali nepripravljenih udeležencev škodljivemu gradivu.

Vendar pa prevelik nadzor ogroža zasebnost uporabnikov. Pravo ravnovesje ščiti uporabnike in hkrati ohranja njihovo agencijo.

Zaščita identitete in privolitev

Manipulacija identitete prek vedno bolj realističnih avatarjev umetne inteligence zahteva ovrednotenje protokolov za soglasje in vzpostavljenih zaščitnih ukrepov za zaščito identitete. Ali so uvedene zadostne smernice za preprečevanje uporabe osebne identitete brez soglasja ali ustvarjanje globokih ponaredkov?

Ali pravilniki odvračajo goljufive osebe ali nadlegovanje? Preučevanje pravnih in etičnih protokolov oceni, kako organizacija daje prednost pravicam uporabnikov.

Starostne omejitve in potrebe po starševskem nadzoru

Ko avatarji z umetno inteligenco napredujejo pri simuliranju človeških interakcij in osebnosti, ocenjevanje njihove starostne primernosti in omejitev pomaga določiti varnost za mlajše demografske skupine. Preučevanje uveljavljanja predpisov COPPA, privzetih starostnih omejitev, razpoložljivosti otroških profilov s poostrenimi omejitvami in učinkovitosti sistemov za preverjanje identitete je bistvenega pomena.

Poleg tega je ključnega pomena ocena, ali ustrezna orodja za starševski nadzor, načini družinske varnosti in izobraževalni viri skrbnikom omogočajo sprejemanje premišljenih odločitev glede uporabe otrok. Odgovorne platforme za avatarje bi morale dati prednost zaščiti glede na starost in omogočiti starševski nadzor namesto dovoljevanja nekontroliranega dostopa mladoletnikom.

Etični vidiki privolitve, odgovorna uporaba,

Etične posledice vse bolj realističnih sistemov avatarjev umetne inteligence prav tako upravičujejo oceno z vidika uporabniških pravic in soglasja. Na primer, ustvarjanje podrobnih virtualnih dvojnikov brez soglasja ali napačno predstavljanje identitete lahko predstavlja etična vprašanja, tudi če ni pravno kaznivo.

Smernice za odgovorno uporabo glede ustvarjanja identitete, omejitev žaljive vsebine, prepovedi goljufivih kaznivih dejanj itd. prikazujejo prednostne naloge platforme glede dobrega počutja uporabnika.

Spet omogočanje nadzora uporabnika, kot je brisanje identitete in izbris podatkov o pogovoru, pomeni omogočanje privolitve in posredništva. Ko zmožnosti avatarjev rastejo, morajo etični vidiki slediti, da se prepreči zloraba in kršitve uporabniških pravic, hkrati pa uravnotežiti inovativne aplikacije. Redne zunanje presoje pomagajo uskladiti napredek z etičnimi standardi.

Najboljše prakse za varno uporabo

Ko postajajo avatarji z umetno inteligenco in klepetalni roboti vse bolj vidni, vzpostavitev preudarnih smernic za uporabo ščiti posameznike in skupnosti pred kršitvijo zasebnosti ali zlorabo, hkrati pa podpira nenehne odgovorne inovacije. Z obveščanjem uporabnikov o razumnih praksah platforme za avatarje poleg novih aplikacij omogočajo posredovanje in dajejo prednost soglasju in etičnim vidikom.

Sprejemanje najboljših praks pomaga vzdrževati konstruktivne interakcije, ohranja pravice uporabnikov in poudarja vidike posebnih demografskih skupin, kot so otroci. Poleg tega široko sprejetje načel varne uporabe pomaga odgovorno oblikovati razvoj te nastajajoče tehnologije.

Previdnost pri deljenju osebnih podatkov

Ko se pogovarjajo z avatarji umetne inteligence, morajo uporabniki ravnati po lastni presoji glede skupne rabe zasebnih podrobnosti, kot so naslovi, gesla ali drugi občutljivi podatki. Čeprav so avatarji morda videti prepričljivo podobni ljudem, še vedno predstavljajo programske sisteme, ki so jih ustvarila podjetja, za katera veljajo politike uporabe podatkov. Preudarno se je izogibati razkritju osebnih podatkov, ki jih je mogoče uporabiti.

Bodite obveščeni o pogojih storitve in pravilnikih o zasebnosti

Ker se platforme za avatarje z umetno inteligenco hitro širijo, se lahko njihovi standardi zasebnosti, varnostna orodja in uporabniške politike sčasoma spremenijo. Redno obveščanje o njihovih najnovejših pogojih storitve in postopkih podatkov zagotavlja zavedanje o tem, kako so osebni podatki zavarovani in uporabljeni. To omogoča hitro identifikacijo morebitnih zadevnih premikov.

Starševski nadzor za mladoletne uporabnike

Nadzor skrbnikov je ključnega pomena, medtem ko mladoletni posamezniki komunicirajo z osebami umetne inteligence, da preprečijo starostno neprimerne izpostavljenosti ali incidente pri izmenjavi informacij. Orodja za starševski nadzor, ki jih zagotavlja platforma, načini za varnost otrok in viri družinskega usmerjanja pomagajo omogočiti zaščitena okolja. Idealna je kombinacija zunanjega nadzora in zaščite ploščadi.

Prijava neprimerne vsebine ali vedenja

Jasna in dostopna orodja za poročanje za označevanje žaljivega vedenja avatarjev razvijajo bolj zdravo okolje. Ne glede na to, ali jih sproži umetna inteligenca ali človek, platforme za opozarjanje na kršitve pravilnikov, kršitve identitete ali zlorabe omogočajo odškodnino in pomagajo izboljšati varnostne ukrepe sistema.

Informacije o preverjanju dejstev, ki jih delijo liki z umetno inteligenco

Kljub naprednim zmožnostim lahko avatarji umetne inteligence delijo lažne informacije ali ohranjajo pristranskost skozi pogovore. Zato bi morali uporabniki kritično analizirati podane izjave, namesto da bi domnevali zanesljivost, s čimer spodbujajo platforme, da povečajo preverjanje točnosti.

Prihodnost likov/avatarjev AI

Ker klepetalni roboti z umetno inteligenco in virtualni spremljevalci še naprej napredujejo, postajajo vse bolj realistični in interaktivni, njihova prihodnost obeta vznemirljive nove aplikacije poleg razvijajočih se varnostnih vprašanj.

Platforme za avatarje z umetno inteligenco naj bi postale bolj vsestranske in večnamenske z izboljšavami, kot so utelešenja videa in AR, razširjena čustvena inteligenca in ustvarjalnost, globlja personalizacija in kontekstualna angažiranost. Ker se osnovni jezikovni modeli še naprej izpopolnjujejo s povečanim številom podatkov in optimizacijami, lahko avatarji prepričljivo prestanejo dolgotrajne "turingove teste", ki kažejo izjemno človeško vedenje.

S takšnim napredkom bi se lahko aplikacije razširile na čustveno podporo, prilagojeno izobraževanje, interaktivno igranje iger, dostopne virtualne odnose in bolj poglobljene zabavne medije. Podjetja lahko uporabijo inteligentne virtualne pomočnike za izboljšanje uporabniške izkušnje in celo preizkušanje izdelkov ali storitev prek fokusnih skupin AI.

Vendar pa se tveganja v zvezi s privolitvijo, čustveno manipulacijo, izkoriščanjem podatkov, napačnimi informacijami in pomanjkljivostmi v osnovni pristranskosti prav tako povečujejo s takšnim napredkom. Zato bodo trajne varnostne ocene, zunanje revizije praks in etični nadzor umetne inteligence ostali ključni. Arhitekture, kot je ustavna umetna inteligenca, ki usklajujejo napredek s človeškimi vrednotami z večjo preglednostjo, odgovornostjo in nadzorom, obljubljajo odgovorne inovacije.

Na splošno imajo avatarji umetne inteligence s skupnimi prizadevanji med uporabniki, oblikovalci politik, raziskovalci in platformami ogromen potencial kot tehnologije za opolnomočenje ljudi in ne zgolj kot orodja za komercialne interese.

Zavijanje

Ker platforme za avatarje, ki jih poganja umetna inteligenca, kot je Character AI, še naprej napredujejo in vse bolj natančno posnemajo človeške interakcije, se njihov vznemirljivi potencial prepleta z razvijajočimi se tveganji. Čeprav takšne inovacije obljubljajo aplikacije od zabave do izobraževanja, bi lahko njihova zloraba posegla v zasebnost, manipulirala z uporabniki ali ohranjala pristranskost.

Zato je poleg napredka podjetij, kot je Character AI in drugih, ocenjevanje in krepitev etičnih zaščitnih ukrepov ključnega pomena. Dejavniki, kot so protokoli soglasja, nadzor starosti, politike dezinformacij, pregledni modeli nadzora in načela uporabe skupnosti, bodo vplivali na to, ali bodo te platforme opolnomočile uporabnike ali jih izkoriščale. S pazljivim napredkom, ki inovacije avatarjev umetne inteligence usklajuje s človeškimi vrednotami, je mogoče negovati njihove koristi, hkrati pa zmanjšati tveganja.