Como um entusiasta de IA, testemunhei a incrível ascensão de modelos de linguagem grandes (LLMs) em primeira mão. Essas poderosas ferramentas de IA revolucionaram a forma como interagimos com a tecnologia, gerando dilemas para empresas e indivíduos.

Devemos adotar a conveniência dos serviços de assinatura ou assumir o controle hospedando nossos modelos? Essa questão não é apenas sobre custo — ela toca em desempenho, privacidade e escalabilidade.

Nesta postagem do blog, explorarei ambas as opções, aproveitando minha experiência e as últimas tendências do setor para ajudar você a tomar uma decisão informada que esteja alinhada às suas necessidades e recursos específicos.

Hospedagem LLM vs Assinatura ChatGPT: Compreendendo as opções

Vamos analisar nossos dois principais concorrentes na área de LLM.

Create Amazing Websites

Com o melhor criador de páginas gratuito Elementor

Comece agoraAssinatura ChatGPT

O ChatGPT se tornou um nome familiar por um bom motivo. Como assinante, você obtém:

- Acesso a modelos de linguagem de última geração

- Atualizações e melhorias regulares

- Uma interface amigável

- API robusta para integração em vários aplicativos

O preço é direto: você paga com base no seu uso. Para usuários casuais ou pequenas empresas, isso pode ser bem econômico.

LLMs de código aberto com auto-hospedagem

Por outro lado, temos a abordagem DIY. Modelos populares de código aberto como LLaMA e GPT-NeoX oferecem:

- Controle total sobre seu modelo

- Opções de personalização

- Privacidade de dados

- Potencial para economia de custos em escala

Você tem duas opções principais de implantação aqui:

a) Hospedagem em nuvem (AWS, Google Cloud, Azure)

b) Hardware local

Cada caminho tem seus prós e contras, que exploraremos em profundidade à medida que avançamos.

A escolha entre essas opções nem sempre é clara. Depende de suas necessidades específicas, recursos e objetivos de longo prazo. Nas seções a seguir, eu o guiarei pelos principais fatores a serem considerados, ajudando você a tomar a melhor decisão para sua situação única.

Comparação de custos

Quando se trata de LLMs, o custo geralmente é um fator decisivo importante. Vamos decompor os números.

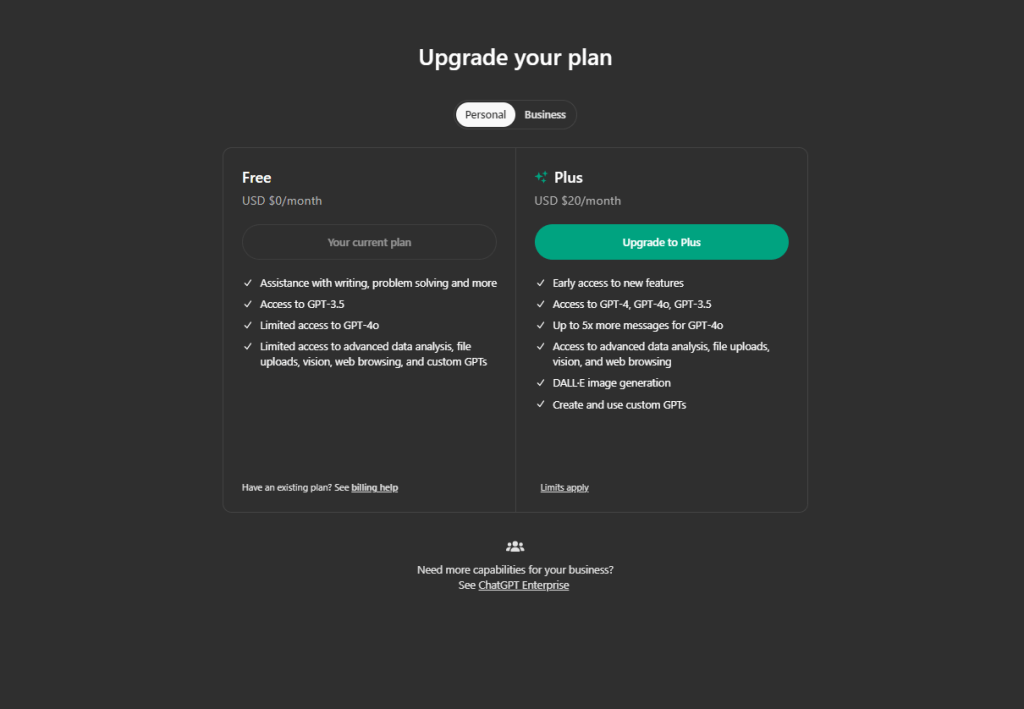

Assinatura ChatGPT

se usarmos o ChatGPT, a assinatura custará:

- Atualmente, a OpenAI cobra US$ 0,002 por 1K tokens.

- Para efeito de comparação, tokens de 1K equivalem a aproximadamente 750 palavras.

- Um dia típico com 5.000 consultas pode custar cerca de US$ 6,5.

- Isso equivale a cerca de US$ 200 por mês para uso moderado.

Parece razoável, certo? Mas aqui está o problema: os custos podem disparar com uso intenso. Sua conta mensal pode rapidamente se tornar exorbitante se você estiver lidando com milhares de consultas diariamente.

LLMs de código aberto de auto-hospedagem

Se você quiser criar seu próprio LLM auto-hospedado, custará:

- Hardware: Uma GPU de ponta como uma NVIDIA RTX 3090 custa cerca de US$ 700.

- Hospedagem em nuvem: a AWS pode custar entre US$ 150 e US$ 160 por dia para 1 milhão de solicitações.

- Não se esqueça da eletricidade: por US$ 0,12/kWh, usar uma GPU potente 24 horas por dia, 7 dias por semana, compensa.

- Custos de mão de obra: você precisará de experiência para configurar e manter seu sistema.

A configuração inicial para auto-hospedagem é mais cara, mas pode ser mais econômica para uso de alto volume ao longo do tempo.

Custos ocultos a considerar:

- Tempo: Configurar um sistema auto-hospedado não é instantâneo.

- Atualizações: A tecnologia evolui rapidamente no mundo da IA.

- Tempo de inatividade: sistemas auto-hospedados podem enfrentar mais interrupções.

O veredito: O modelo de assinatura do ChatGPT geralmente vence em termos de custo para usuários de baixo volume. Mas se você estiver olhando para milhões de consultas mensais, a auto-hospedagem pode economizar dinheiro a longo prazo.

Desempenho e Qualidade

Quando se trata de LLMs, o desempenho é rei. Vamos mergulhar em como o ChatGPT e os modelos de código aberto se comparam:

Capacidades do ChatGPT

- Respostas consistentemente de alta qualidade

- Ampla base de conhecimento abrangendo diversos tópicos

- Atualizações regulares melhorando o desempenho

- Capacidade de lidar com consultas e tarefas complexas

Achei o ChatGPT particularmente impressionante em cenários de escrita criativa e resolução de problemas. Suas respostas geralmente parecem humanas e contextualmente apropriadas.

Desempenho LLM de código aberto

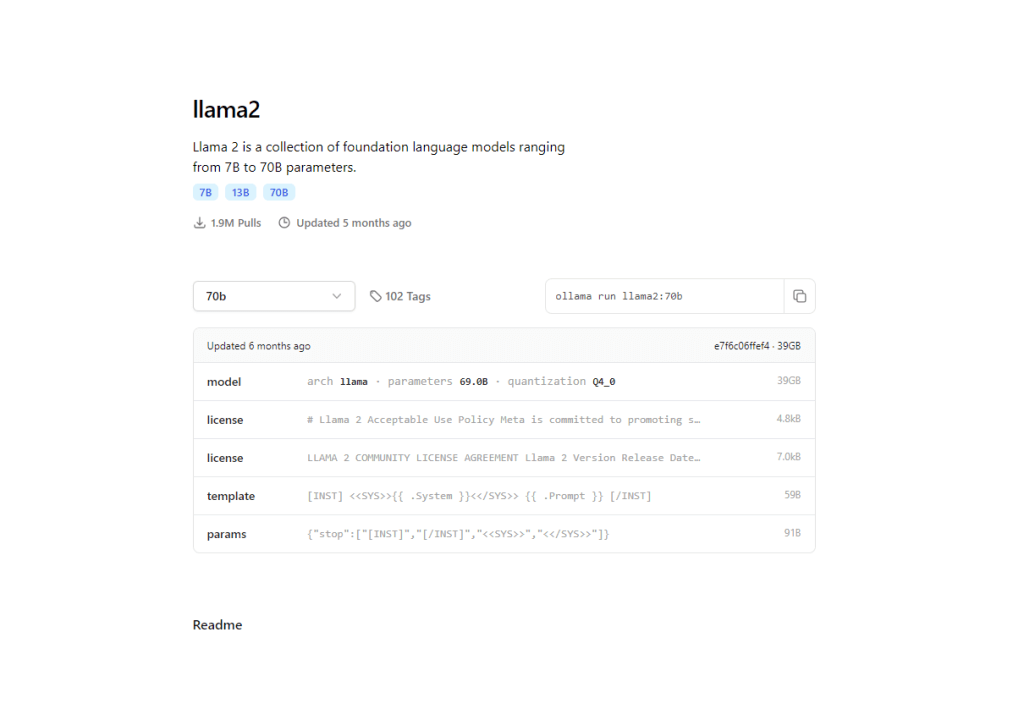

- Modelos como o LLaMA 2 estão se atualizando rapidamente

- Alguns modelos especializados superam o ChatGPT em domínios específicos

- Potencial de personalização para otimização específica de tarefas

Na minha experiência, modelos recentes de código aberto como LLaMA 2 70B podem igualar ou até mesmo exceder GPT-3.5 em tarefas específicas. A lacuna está diminuindo rapidamente.

É aqui que os modelos de código aberto brilham. Com auto-hospedagem, você pode:

- Treine em dados específicos de domínio

- Otimizar para tarefas específicas

- Potencialmente supera modelos genéricos em aplicações de nicho

As empresas alcançaram resultados notáveis ao ajustar modelos de código aberto às suas necessidades específicas.

Agora, se considerarmos o Desempenho,

- Latência: modelos auto-hospedados podem oferecer tempos de resposta mais baixos

- Personalização: Adapte modelos de código aberto às suas necessidades exatas

- Consistência: o ChatGPT garante desempenho confiável em várias tarefas

O veredito: O ChatGPT oferece desempenho de primeira linha pronto para uso. No entanto, se você tem necessidades específicas e especializadas, um modelo de código aberto ajustado pode potencialmente superá-lo em seu caso de uso específico.

Privacidade e controle de dados

Hoje em dia, a privacidade não é apenas um luxo — é uma necessidade. Vamos examinar como o ChatGPT e os LLMs auto-hospedados lidam com esse aspecto crucial:

Tratamento de dados do ChatGPT

- A OpenAI tem políticas de privacidade rígidas

- Os dados enviados ao ChatGPT podem ser usados para melhoria do modelo

- Opção de cancelar o compartilhamento de dados, mas com potenciais compensações de desempenho

Embora a OpenAI esteja comprometida com a privacidade do usuário, enviar dados sensíveis a terceiros sempre traz algum risco. Já vi empresas hesitarem em usar o ChatGPT para informações confidenciais.

Benefícios do LLM de auto-hospedagem

- Controle total sobre seus dados

- Nenhum risco de exposição de dados externos

- Capacidade de implementar medidas de segurança personalizadas

Na minha experiência, esse nível de controle é um divisor de águas para setores como saúde ou finanças, onde a privacidade dos dados é primordial.

Trabalhei com empresas que escolheram a auto-hospedagem especificamente para atender a rigorosos requisitos de conformidade.

Principais fatores de privacidade:

- Propriedade dos dados: com a auto-hospedagem, você mantém a propriedade total dos seus dados e modelo

- Transparência: modelos de código aberto permitem que você inspecione e entenda o código

- Personalização: implemente recursos de privacidade adaptados às suas necessidades específicas

O Veredito: Se a privacidade de dados é sua maior prioridade, a auto-hospedagem de um LLM de código aberto lhe dá um controle inigualável. No entanto, as medidas de privacidade robustas do ChatGPT podem ser suficientes para aplicativos menos sensíveis.

Escalabilidade e Flexibilidade

Vamos explorar como o ChatGPT e os LLMs auto-hospedados se comparam em termos de escalabilidade e flexibilidade.

Opções de escalabilidade do ChatGPT

- Escalabilidade perfeita com uso aumentado

- Não é necessário gerenciamento de infraestrutura

- A API permite fácil integração em vários aplicativos

Se falamos sobre potencial de personalização, o ChatGPT é limitado a parâmetros de API e engenharia rápida.

Vi empresas escalarem rapidamente suas capacidades de IA usando o ChatGPT sem se preocupar com a logística de backend. É impressionantemente livre de problemas.

Flexibilidade de LLM auto-hospedado

- Controle total sobre o tamanho e as capacidades do modelo

- Capacidade de escalar horizontalmente em várias máquinas

- Liberdade para otimizar configurações de hardware específicas

Para personalização futura, você terá acesso total à arquitetura do modelo e poderá treinar dados em um nível avançado.

Nos meus projetos, esse nível de controle tem sido inestimável para ajustar o desempenho e a eficiência de custos.

O Veredito: O ChatGPT se destaca em escalabilidade sem esforço, tornando-o ideal para empresas com demandas flutuantes. No entanto, a auto-hospedagem oferece flexibilidade inigualável para aqueles dispostos a gerenciar sua própria infraestrutura.

Considerações técnicas

Como trabalho com IA há muito tempo, posso dizer que os aspectos técnicos são cruciais. Vamos detalhar o que você precisa saber.

Para o ChatGPT, você precisa de uma configuração mínima, e o OpenAI já gerencia o resto.

Para auto-hospedar um modelo LLM, você precisa entender profundamente o aprendizado de máquina e o processamento de linguagem natural. Seria melhor ter proficiência em infraestrutura de nuvem ou gerenciamento de hardware não local. Além disso, você também precisará de vasto conhecimento em ajuste fino e otimização.

Muitas pessoas subestimam a expertise necessária, o que leva a contratempos. Não se trata apenas de baixar um modelo — trata-se de implantá-lo e mantê-lo efetivamente.

Principais fatores técnicos:

- Latência: modelos auto-hospedados podem oferecer tempos de resposta mais baixos se otimizados corretamente

- Personalização: Controle total sobre a arquitetura do modelo e dados de treinamento

- Depuração: mais fácil diagnosticar e corrigir problemas com modelos auto-hospedados

O Veredito: ChatGPT é o vencedor claro para aqueles que buscam uma solução plug-and-play. No entanto, se você tem a expertise técnica e o desejo de controle total, a auto-hospedagem pode oferecer personalização incomparável e potenciais benefícios de desempenho.

Análise de Caso de Uso

Como profissional de IA, vi vários cenários em que diferentes soluções de LLM brilham. Vamos explorar alguns casos de uso do mundo real para orientar sua decisão.

Assinatura ChatGPT

Pequenas e médias empresas geralmente se beneficiam da facilidade de uso do ChatGPT. Com recursos técnicos limitados e uma necessidade de implantação rápida, vi startups prototiparem rapidamente recursos de IA, economizando meses de tempo de desenvolvimento.

As equipes de Criação de Conteúdo e Marketing prosperam com os diversos recursos de linguagem do ChatGPT. Uma agência de marketing com a qual trabalhei usou-o para fazer brainstorming de ideias de campanha e rascunhar posts de mídia social, aumentando significativamente sua produtividade.

Customer Support Automation é outra área em que o ChatGPT se destaca. Sua disponibilidade 24/7 e capacidade de lidar com consultas gerais o tornam uma escolha para muitas empresas que aconselhei.

LLMs de auto-hospedagem

Grandes empresas com altos volumes geralmente acham a auto-hospedagem mais econômica. Ajudei uma plataforma de e-commerce a mudar para um modelo de auto-hospedagem, cortando seus custos de IA em 60% ao longo de um ano.

Indústrias altamente regulamentadas se beneficiam do controle que a auto-hospedagem oferece. Uma empresa fintech que aconselhei escolheu essa rota para garantir a conformidade com o GDPR e proteger dados financeiros sensíveis.

Aplicações de Domínio Especializadas geralmente exigem modelos personalizados. Trabalhei com uma startup de tecnologia jurídica que ajustou um modelo de código aberto em documentos legais, superando modelos genéricos em análise de contratos.

Fatores-chave - incluem volume de consultas, sensibilidade de dados, recursos técnicos e necessidades de personalização. Volumes maiores e dados mais sensíveis frequentemente justificam a auto-hospedagem, enquanto recursos limitados favorecem o ChatGPT.

Conclusão

Depois de mergulhar fundo no mundo dos LLMs, fica claro que a escolha entre ChatGPT e modelos auto-hospedados não é preto e branco. Como um entusiasta e profissional de IA, vi implementações bem-sucedidas de ambas as abordagens.

O ChatGPT brilha em sua facilidade de uso, desempenho consistente e atualizações regulares. É uma excelente escolha para empresas que buscam uma solução de IA rápida e sem complicações. O modelo de assinatura funciona bem para uso moderado e aplicativos gerais.

A auto-hospedagem, por outro lado, oferece controle incomparável, potencial de personalização e privacidade de dados. É ideal para usuários de alto volume, aplicativos especializados e indústrias com regulamentações de dados rígidas. A configuração inicial pode ser desafiadora, mas os benefícios a longo prazo podem ser substanciais.

Lembre-se, esta não é uma escolha permanente. Conforme suas necessidades evoluem e o cenário de IA muda, você sempre pode reavaliar e mudar de abordagem.

No final das contas, a melhor escolha é aquela que se alinha com seus objetivos, recursos e visão para integração de IA em seu fluxo de trabalho. Não importa se você opta pela conveniência do ChatGPT ou pelo controle de auto-hospedagem, você está entrando em um mundo emocionante de possibilidades alimentadas por IA.