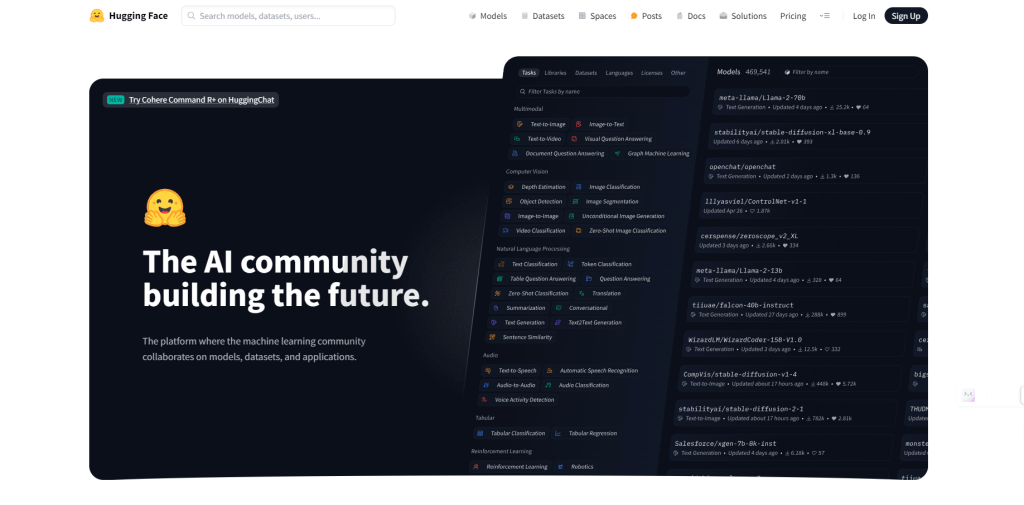

Hugging Face는 자연어 처리에 관심이 있는 모든 사람을 위한 금광으로, 다양한 애플리케이션에서 사용하기 매우 쉬운 사전 훈련된 다양한 언어 모델로 가득 차 있습니다. LLM(대형 언어 모델)의 경우 Hugging Face가 최고의 선택입니다. 이 글에서는 Hugging Face의 상위 10개 LLM에 대해 살펴보겠습니다. 각 LLM은 언어를 이해하고 생성하는 방법을 발전시키는 데 중추적인 역할을 합니다.

시작하자!

대규모 언어 모델이란 무엇입니까?

LLM(대형 언어 모델)은 인간 언어를 이해하고 생성하도록 설계된 고급 유형의 인공 지능입니다. 이는 딥러닝 기술, 특히 변환기라고 불리는 일종의 신경망을 사용하여 구축되었습니다.

이를 명확히 하기 위한 분석은 다음과 같습니다.

- 대규모 데이터 교육 : LLM은 책, 기사, 웹 사이트 등을 포함하는 대규모 데이터 세트에 대해 교육을 받습니다. 이 광범위한 훈련은 문법, 문맥, 심지어 어느 정도의 추론을 포함하여 언어의 뉘앙스를 배우는 데 도움이 됩니다.

- Transformers : 대부분의 LLM 뒤에 있는 아키텍처를 변환기라고 합니다. 이 모델은 주의 메커니즘을 사용하여 문장 내 다양한 단어의 중요성을 평가하므로 이전 모델보다 맥락을 더 잘 이해할 수 있습니다.

- 수행하는 작업 : 교육을 받은 LLM은 다양한 언어 작업을 수행할 수 있습니다. 여기에는 질문에 답하기, 텍스트 요약, 언어 번역, 창의적인 글쓰기 생성 및 코딩이 포함됩니다.

- 인기 모델 : 잘 알려진 일부 LLM에는 GPT-3, BERT 및 T5가 있습니다. 이러한 사전 훈련된 모델은 특정 작업에 맞게 미세 조정될 수 있으므로 개발자와 연구원을 위한 다양한 도구가 됩니다.

- 응용 프로그램 : LLM은 챗봇, 가상 비서, 자동화된 콘텐츠 생성 등에 사용됩니다. 이는 기계가 인간의 언어를 보다 자연스럽게 이해하고 응답하도록 함으로써 사용자와 기술의 상호 작용을 개선하는 데 도움이 됩니다.

본질적으로 대형 언어 모델은 컴퓨터의 강력한 두뇌와 같아서 인상적인 정확성과 다양성으로 인간 언어를 처리하고 생성할 수 있습니다.

허깅페이스 & LLM

Hugging Face는 자연어 처리(NLP) 및 기계 학습의 허브가 된 회사이자 플랫폼입니다. 개발자와 연구자가 기계 학습 모델, 특히 언어 이해 및 생성과 관련된 모델을 보다 쉽게 구축하고 사용할 수 있도록 도구, 라이브러리 및 리소스를 제공합니다.

Hugging Face는 오픈 소스 라이브러리, 특히 광범위한 사전 훈련된 언어 모델에 쉽게 액세스할 수 있는 Transformers 로 유명합니다.

Hugging Face는 GPT-3, BERT 및 T5와 같은 많은 최첨단 LLM을 호스팅합니다. 이러한 모델은 대규모 데이터 세트에 대해 사전 학습되었으며 다양한 애플리케이션에 사용할 준비가 되어 있습니다.

이 플랫폼은 기계 학습에 대한 깊은 전문 지식 없이도 이러한 모델을 애플리케이션에 통합하기 위한 간단한 API와 도구를 제공합니다.

Hugging Face의 도구를 사용하면 사전 훈련된 LLM을 자신의 데이터에 맞게 쉽게 미세 조정하여 특정 작업이나 도메인에 적용할 수 있습니다.

연구원과 개발자는 Hugging Face 플랫폼에서 모델과 개선 사항을 공유하여 NLP의 혁신과 적용을 가속화할 수 있습니다.

꼭 사용해야 할 Huggingface의 상위 5개 LLM 모델

스토리텔링에 탁월하고 GPT를 능가하는 Hugging Face의 최고의 LLM 모델 중 일부를 살펴보겠습니다.

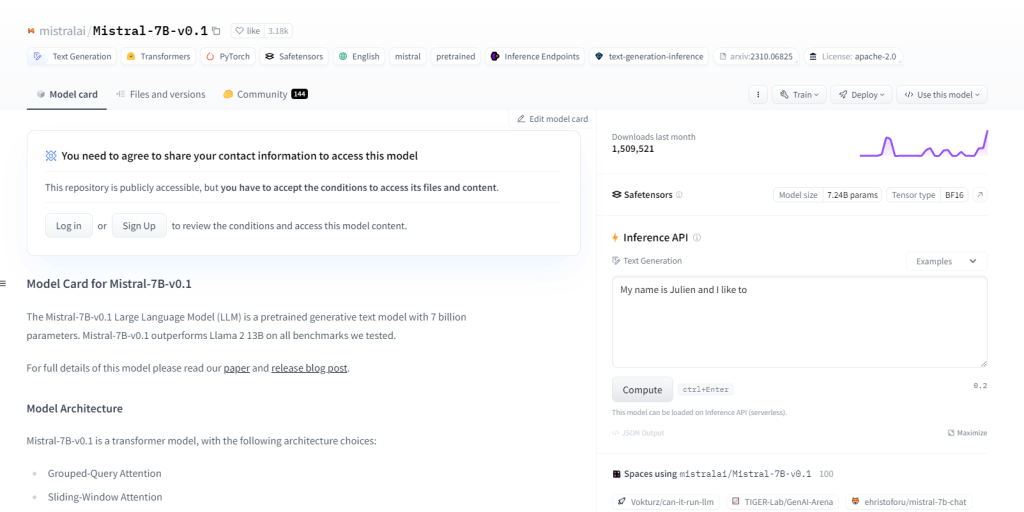

미스트랄-7B-v0.1

70억 개의 매개변수를 갖춘 LLM(대형 언어 모델)인 Mistral-7B-v0.1은 도메인 전체에서 Llama 2 13B와 같은 벤치마크보다 성능이 뛰어납니다. 특정 주의 메커니즘과 바이트 폴백 BPE 토크나이저를 갖춘 변환기 아키텍처를 활용합니다. 텍스트 생성, 자연어 이해, 언어 번역에 탁월하며 NLP 프로젝트의 연구 개발을 위한 기본 모델 역할을 합니다.

주요 특징들

- 70억 개의 매개변수

- Llama 213B와 같은 벤치마크를 능가합니다.

- 트랜스포머 아키텍처

- BPE 토크나이저

- NLP 프로젝트 개발

- 자연어 이해

- 언어 번역

- 그룹화된 쿼리 주의

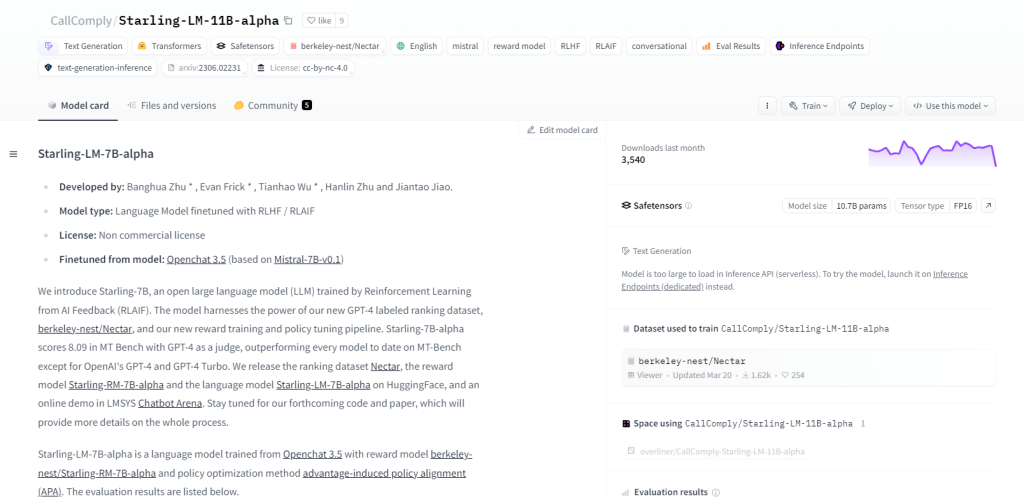

Starling-LM-11B-알파

110억 개의 매개변수를 가진 LLM(대형 언어 모델)인 Starling-LM-11B-alpha는 OpenChat 3.5 모델을 기반으로 NurtureAI에서 등장합니다. 미세 조정은 사람이 지정한 순위에 따라 AI 피드백의 강화 학습(RLAIF)을 통해 이루어집니다. 이 모델은 오픈 소스 프레임워크와 NLP 작업, 기계 학습 연구, 교육 및 창의적인 콘텐츠 생성을 포함한 다양한 애플리케이션을 통해 인간과 기계의 상호 작용을 재구성할 것을 약속합니다.

주요 특징들

- 110억 개의 매개변수

- NurtureAI에서 개발

- OpenChat 3.5 모델 기반

- RLAIF를 통해 미세 조정됨

- 훈련을 위해 사람이 지정한 순위

- 오픈 소스 성격

- 다양한 기능

- 연구, 교육, 창의적 콘텐츠 생성에 활용

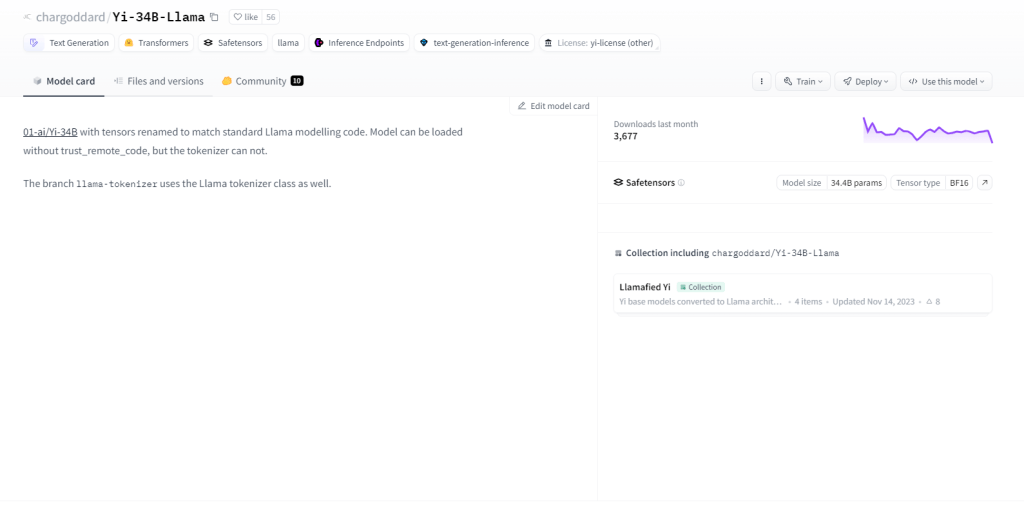

Yi-34B-라마

340억 개의 매개변수를 갖춘 Yi-34B-Llama는 뛰어난 학습 능력을 보여줍니다. 다중 모드 처리, 텍스트, 코드 및 이미지를 효율적으로 처리하는 데 탁월합니다. 제로샷 학습을 수용하여 새로운 작업에 원활하게 적응합니다. 상태 저장 특성을 통해 과거 상호 작용을 기억하여 사용자 참여를 향상할 수 있습니다. 사용 사례에는 텍스트 생성, 기계 번역, 질문 답변, 대화, 코드 생성 및 이미지 캡션이 포함됩니다.

주요 특징들

- 340억 개의 매개변수

- 다중 모드 처리

- 제로샷 학습 기능

- 상태 저장 성격

- 텍스트 생성

- 기계 번역

- 질문 답변

- 이미지 캡션

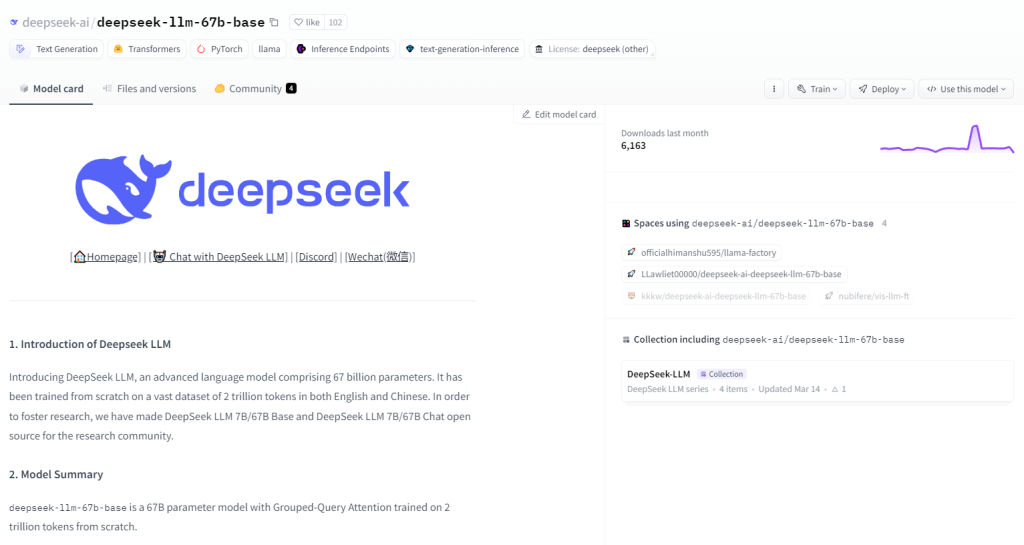

DeepSeek LLM 67B 베이스

670억 매개변수의 대규모 언어 모델(LLM)인 DeepSeek LLM 67B Base는 추론, 코딩 및 수학 작업에서 빛을 발합니다. GPT-3.5 및 Llama2 70B Base를 능가하는 탁월한 점수로 코드 이해 및 생성이 뛰어나고 뛰어난 수학 능력을 보여줍니다. MIT 라이센스에 따른 오픈 소스 특성으로 인해 무료 탐색이 가능합니다. 사용 사례는 프로그래밍, 교육, 연구, 콘텐츠 제작, 번역 및 질문 답변에 걸쳐 있습니다.

주요 특징들

- 670억 개의 매개변수

- 추론, 코딩, 수학 분야에서 뛰어난 성능

- HumanEval Pass@1 점수 73.78점

- 뛰어난 코드 이해 및 생성

- GSM8K 0-shot에서 높은 점수(84.1)

- 언어 기능에서 GPT-3.5를 능가합니다.

- MIT 라이선스에 따른 오픈 소스

- 뛰어난 스토리텔링 및 콘텐츠 제작 능력.

Skote - Svelte 관리 및 대시보드 템플릿

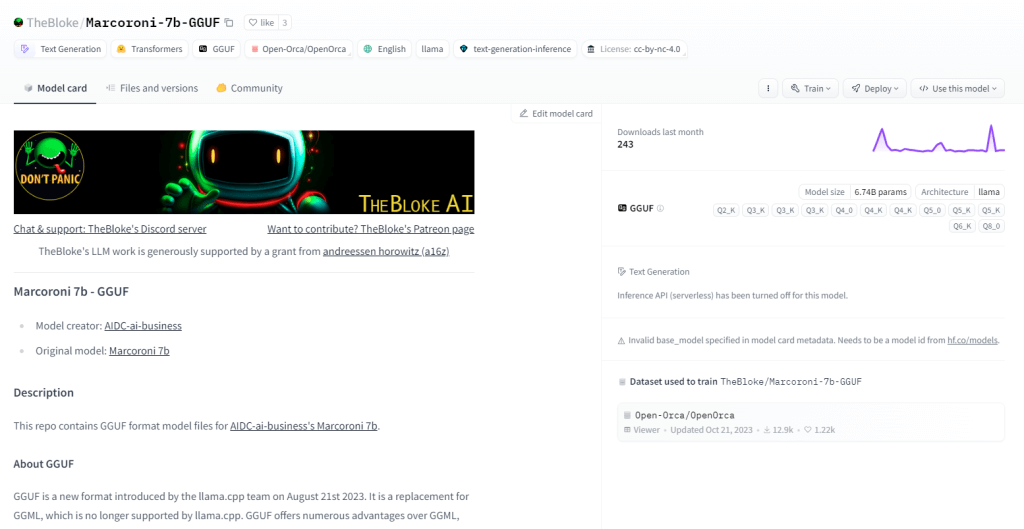

Marcoroni-7B-v3은 텍스트 생성, 언어 번역, 창의적인 콘텐츠 생성, 질문 응답 등 다양한 작업을 수행할 수 있는 강력한 70억 매개변수의 다국어 생성 모델입니다. 사전 교육 없이 빠른 작업 수행을 위해 제로샷 학습을 활용하여 텍스트와 코드를 모두 처리하는 데 탁월합니다. 오픈 소스 및 허용 라이선스에 따라 Marcoroni-7B-v3은 광범위한 사용과 실험을 촉진합니다.

주요 특징들

- 시, 코드, 스크립트, 이메일 등을 위한 텍스트 생성.

- 정확도가 높은 기계 번역.

- 자연스러운 대화로 매력적인 챗봇을 만듭니다.

- 자연어 설명에서 코드 생성.

- 포괄적인 질문 답변 기능.

- 긴 텍스트를 간결한 요약으로 요약합니다.

- 원래 의미를 유지하면서 효과적인 의역.

- 텍스트 콘텐츠에 대한 감정 분석.

마무리

Hugging Face의 대규모 언어 모델 컬렉션은 개발자, 연구원, 매니아 모두에게 획기적인 변화를 가져옵니다. 이러한 모델은 다양한 아키텍처와 기능 덕분에 자연어 이해 및 생성의 경계를 넓히는 데 큰 역할을 합니다. 기술이 발전함에 따라 이러한 모델의 적용과 영향은 끝이 없습니다. 대규모 언어 모델을 탐색하고 혁신하는 여정은 계속 진행 중이며 앞으로 흥미로운 발전을 약속합니다.