Character AI のような AI を活用した仮想キャラクターやアバターの台頭は、エンターテイメントや交友関係などに刺激的な可能性をもたらします。ただし、これらの AI ペルソナの人気が高まるにつれて、データのプライバシー、個人情報の操作、年齢に応じたコンテンツ、倫理的な使用に関する懸念も高まっています。

仮想作品がますます現実的で魅力的になるにつれて、ユーザーは安全対策と潜在的なリスクを評価しながら、慎重に仮想作品に取り組む必要があります。

この記事では、AI アバターとキャラクター (その仕組み、機能、安全プロトコル、責任ある使用方法) についての詳細な分析を提供し、ユーザーがそれらを賢明に操作する方法を理解できるようにします。私たちは、「AI キャラクターやアバターを使用しても安全ですか?」という重要な質問に答えることを目指しています。彼らの有望な未来を模索しながら。

AI キャラクター/アバターを理解する

Character AIなどのプラットフォームを使用して作成されたものなど、AI を活用した仮想キャラクターやアバターは、自然言語処理テクノロジーを活用してユーザーを会話型の対話に参加させます。基本的に、これらは人間のような性格や行動をシミュレートするように設計されたチャットボットであり、状況に応じた適応的な応答でプロンプトに応答します。

素晴らしいウェブサイトを作成します

最高の無料ページビルダーElementor を使用

今すぐ始める

これらの AI ペルソナを使用すると、ユーザーは独自のアイデンティティの作成から、明確な性格特性、声、感情範囲などの形成まで、高度なカスタマイズが可能になります。ユーザーは、ロールプレイ シナリオ、グループ会話に参加し、アバターの知識ベースを強化するために質問したり、応答に対するフィードバックを提供して時間の経過とともに精度を向上させることもできます。

技術レベルでは、AI アバターは生成事前学習トランスフォーマー (GPT) アーキテクチャとニューラル ネットワークを利用して、入力を理解し、トレーニング データに基づいてインテリジェントな応答を作成します。これらのモデルが進化し続けるにつれて、AI キャラクターのリアリズム、インタラクティブ性、多用途性のレベルは進化し続けています。

慎重な使用と継続的な安全性評価により、AI アバターはエンターテイメント、交友関係、教育、創造性などの豊富な機会を提供します。ただし、ユーザーはその機能、制限、潜在的なリスクについて知らされる必要があります。

AIキャラクター/アバターの安全性の評価

AI を活用したチャットボットや Character AI などのバーチャル コンパニオンの注目度が高まる中、その安全性と責任ある使用慣行をしっかりと評価することが重要です。これらのシステムがより高度で本物に近づくにつれて、企業や個人が無責任に導入すると、プライバシー、同意、倫理的影響に関連する予期せぬリスクが生じる可能性があります。

包括的な安全性評価では、データ セキュリティ、コンテンツ管理、ID 保護、ポリシーの透明性などの主要領域が検査されます。また、保護機能がそれに応じて適応できるように、機能の拡張に伴うシステムの時間の経過に伴う進化についても説明します。 AI アバターの採用が進むにつれて、現在の安全対策を評価し、ユーザーの権利を擁護することが重要です。

データのセキュリティとプライバシー

AI アバター プラットフォームのデータ収集、保存、共有、削除ポリシーを調べることで、プライバシー保護についての洞察が得られます。ベスト プラクティスには、必要なユーザー情報のみを収集すること、ユーザー データの削除を許可すること、システムを侵害から保護すること、データ アクセスを重要なスタッフのみに制限することが含まれます。機能が進歩するにつれて、継続的な監査は、時間の経過とともにプライバシー基準の改善を評価するのに役立ちます。

コンテンツの制御と制限

不適切なコンテンツを制限するために使用されるフィルター、モデレーション、ペアレンタルコントロールの種類を評価することで、AI アバターの安全性が明らかになります。動的なコンテンツ スクリーニング、人間による会話のレビュー、カスタマイズ オプションにより、未成年者や不本意な参加者が有害なコンテンツにさらされるのを防ぐことができます。

ただし、行き過ぎた監視はユーザーのプライバシーを危険にさらします。適切なバランスにより、ユーザーの主体性を維持しながらユーザーを保護できます。

ID の保護と同意

ますます現実的になる AI アバターによるアイデンティティ操作には、同意プロトコルと導入されているアイデンティティ保護の安全策を評価する必要があります。個人情報の同意のない使用やディープフェイクの作成を防止するための十分なガイドラインが実装されていますか?

ポリシーは詐欺的なペルソナやハラスメントを抑止しますか?法的および倫理的なプロトコルを調査することで、組織がユーザーの権利をどのように優先するかを評価します。

年齢制限と保護者の指導の必要性

AI アバターが人間の相互作用や性格をシミュレートする点でより高度になるにつれて、その年齢適切性と制限を評価することは、若年層に対する安全性を判断するのに役立ちます。 COPPA 規制の施行、デフォルトの年齢制限、制限が強化された児童プロフィールの利用可能性、本人確認システムの有効性を調査することが重要です。

さらに、適切なペアレンタルコントロールツール、家族の安全モード、教育リソースにより、保護者が子供の使用に関して情報に基づいた決定を下せるかどうかを評価することが重要です。責任あるアバタープラットフォームは、年齢に応じた保護を優先し、未成年者に無制限のアクセスを許可するのではなく、保護者の監督を可能にする必要があります。

同意、責任ある使用に関する倫理的考慮事項

ますます本物に近づく AI アバター システムの倫理的影響も、ユーザーの権利と同意の観点から評価することを正当化します。たとえば、同意なしに詳細な仮想ドッペルゲンガーを作成したり、身元を偽ったりすることは、法的に処罰されない場合でも倫理上の問題となる可能性があります。

ID の作成、不快なコンテンツの制限、詐欺犯罪の禁止などに関する責任ある使用ガイドラインは、ユーザーの幸福に関するプラットフォームの優先事項を示しています。

繰り返しますが、ID の削除や会話データの消去などのユーザー制御を許可するということは、同意と主体性を有効にすることを意味します。アバターの機能が成長するにつれて、革新的なアプリケーションのバランスをとりながら、誤用やユーザーの権利侵害を防ぐために倫理的配慮も歩調を合わせる必要があります。定期的な外部監査は、進歩を倫理基準に合わせるのに役立ちます。

安全な使用のためのベストプラクティス

AI アバターやチャットボットの存在感が高まるにつれ、賢明な使用ガイドラインを確立することで、個人やコミュニティをプライバシーの侵害や悪用から守り、責任あるイノベーションを継続的にサポートできます。アバター プラットフォームは、賢明な実践についてユーザーに通知することで、代理店を可能にし、新しいアプリケーションと並行して同意と倫理的配慮を優先します。

ベスト プラクティスを採用することは、建設的な相互作用を維持し、ユーザーの権利を保護し、子供などの特定の層に対する考慮事項を強調するのに役立ちます。さらに、安全な使用原則が広く採用されることは、この新興テクノロジーの進化を責任を持って形成するのに役立ちます。

個人情報の共有に関する注意

AI アバターと会話するとき、ユーザーはアドレス、パスワード、その他の機密情報などの個人情報の共有に関して慎重に行動する必要があります。アバターは人間のように見えるかもしれませんが、それでもデータ利用ポリシーの対象となる企業によって作成されたソフトウェア システムを構成します。悪用される可能性のある個人情報の開示を避けることが賢明です。

利用規約とプライバシーポリシーを常に最新の状態に保つ

AI アバター プラットフォームは急速に拡大するため、プライバシー基準、安全ツール、ユーザー ポリシーは時間の経過とともに変更される可能性があります。最新のサービス利用規約とデータ慣行に関する情報を定期的に入手することで、個人情報がどのように保護され、利用されるかについて認識することができます。これにより、関連するシフトを迅速に特定できます。

未成年ユーザーに対する保護者の監督

未成年者が AI ペルソナと対話する際には、年齢不相応な暴露や情報共有事件を防ぐために、保護者の監視が重要です。プラットフォームが提供するペアレンタル コントロール ツール、子供の安全モード、家族向けのガイダンス リソースは、保護された環境を実現するのに役立ちます。外部監視とプラットフォーム保護を組み合わせるのが理想的です。

不適切なコンテンツまたは行為の報告

アバターの不快な行動を警告する明確でアクセスしやすいレポート ツールは、より健全な環境を開発します。 AI か人為的かに関係なく、ポリシー違反、個人情報の侵害、悪用に関するアラート プラットフォームは是正を可能にし、システムの予防策を強化するのに役立ちます。

AIキャラクターが共有する事実確認情報

AI アバターは高度な機能にもかかわらず、会話を通じて誤った情報を共有したり、偏見を永続させたりする可能性があります。したがって、ユーザーは信頼性を前提とするのではなく、発言を批判的に分析する必要があり、プラットフォームに精度チェックを強化するよう促します。

AIキャラクター/アバターの未来

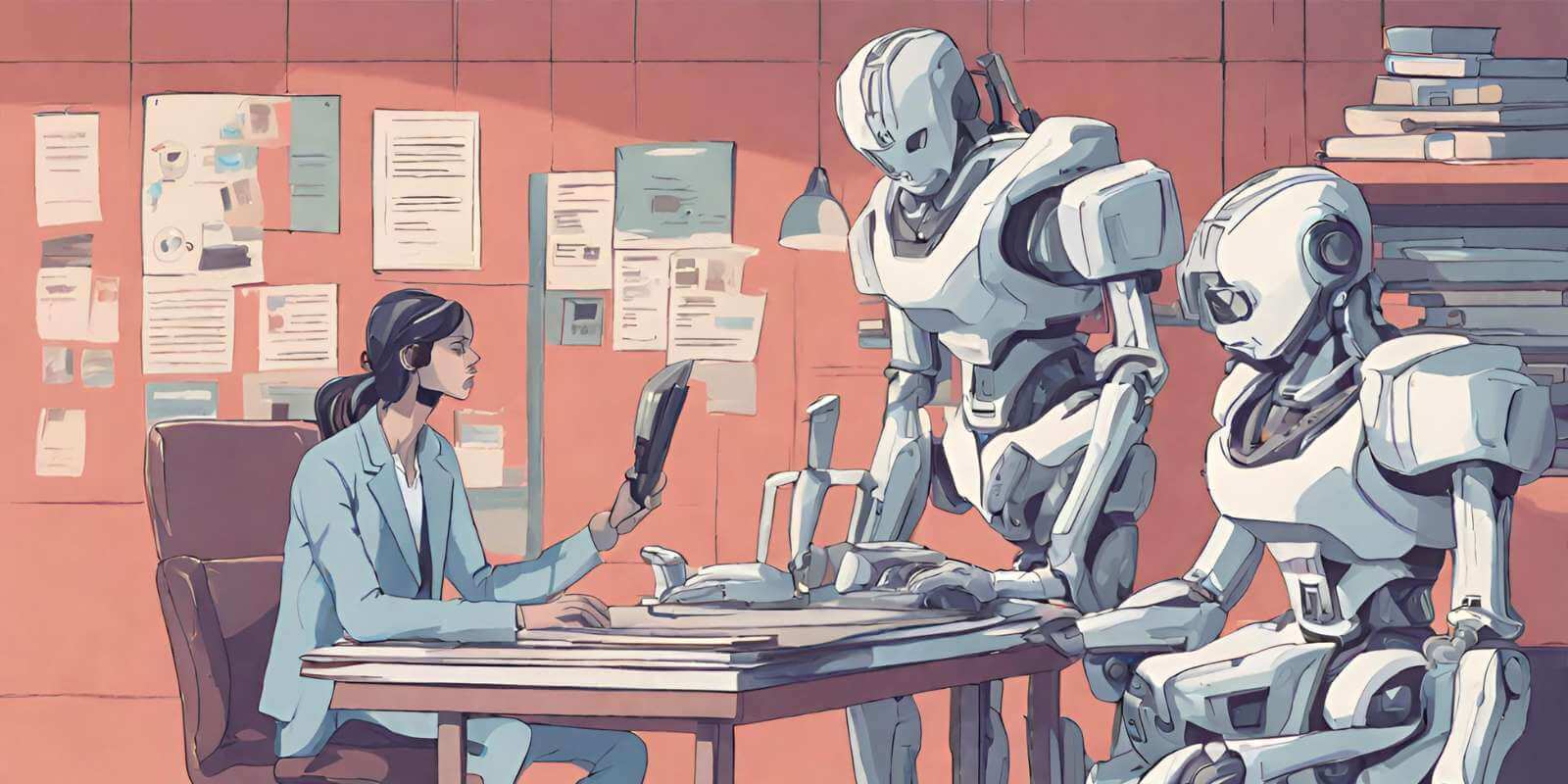

AI チャットボットとバーチャル コンパニオンが進化し続け、より現実的でインタラクティブになるにつれて、その将来は安全性への配慮が進化するとともに、エキサイティングな新しいアプリケーションが約束されています。

AI アバター プラットフォームは、ビデオや AR の具体化、感情的知性と創造性の拡張、より深いパーソナライゼーションとコンテキストへの関与などの機能強化により、より多用途かつ多機能になると予測されています。基礎となる言語モデルがデータの増加と最適化を通じて洗練され続けるにつれて、アバターは、人間らしい振る舞いを示す長期にわたる「チューリング テスト」に納得のいく形で合格する可能性があります。

このような進歩により、アプリケーションは、感情的なサポート、カスタマイズされた教育、インタラクティブなゲーム、アクセス可能な仮想関係、およびより没入型のエンターテイメント メディアに拡張される可能性があります。企業はインテリジェントな仮想アシスタントを採用して顧客エクスペリエンスを向上させたり、AI フォーカス グループを通じて製品やサービスをテストしたりすることもあります。

しかし、同意、感情操作、データ悪用、誤った情報、根底にある偏見の脆弱性をめぐるリスクも、こうした進歩とともに拡大します。したがって、継続的な安全性評価、実践の外部監査、および AI の倫理監視が引き続き重要です。透明性、説明責任、監視の強化を通じて進歩を人間の価値観に合わせる憲法 AI のようなアーキテクチャは、責任あるイノベーションを約束します。

全体として、ユーザー、政策立案者、研究者、プラットフォーム間の協力的な取り組みにより、AI アバターは単なる商業的利益のためのツールとしてではなく、人間に力を与えるテクノロジーとして計り知れない可能性を秘めています。

まとめ

Character AI のような AI を活用したアバター プラットフォームが進歩を続け、人間のインタラクションをより正確に模倣するにつれて、そのエキサイティングな可能性は進化するリスクと絡み合っています。このような技術革新はエンターテイメントから教育までの応用を約束しますが、その悪用はプライバシーを侵害したり、ユーザーを操作したり、偏見を永続させたりする可能性があります。

したがって、 Character AIなどの企業の進歩と並行して、倫理的保護手段を評価し強化することが重要です。同意プロトコル、年齢制限、誤った情報に関するポリシー、透明性のある監視モデル、コミュニティの利用原則などの要素が、これらのプラットフォームがユーザーに力を与えるか消費者を搾取するかを決定します。 AI アバターのイノベーションを人間の価値観に合わせた慎重な進歩を通じて、リスクを最小限に抑えながらその利点を育むことができます。