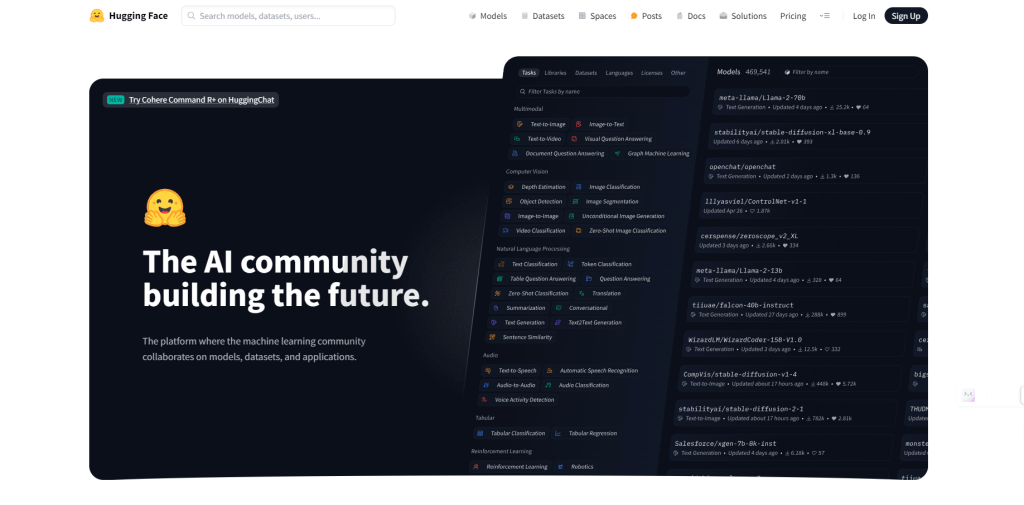

Hugging Face est une mine d'or pour tous ceux qui s'intéressent au traitement du langage naturel, doté d'une variété de modèles de langage pré-entraînés qui sont très faciles à utiliser dans différentes applications. En ce qui concerne les grands modèles linguistiques (LLM), Hugging Face est le premier choix. Dans cet article, nous plongerons dans les 10 meilleurs LLM sur Hugging Face, chacun jouant un rôle central dans l'avancement de la façon dont nous comprenons et générons le langage.

Commençons!

Qu'est-ce que le grand modèle linguistique?

Les grands modèles linguistiques (LLM) sont des types avancés d'intelligence artificielle conçus pour comprendre et générer le langage humain. Ils sont construits à l’aide de techniques d’apprentissage profond, notamment une sorte de réseau neuronal appelé transformateur.

Voici une ventilation pour que ce soit clair:

- Formation sur les données massives: les LLM sont formés sur d'énormes ensembles de données comprenant des livres, des articles, des sites Web, etc. Cette formation approfondie les aide à apprendre les nuances du langage, notamment la grammaire, le contexte et même un certain niveau de raisonnement.

- Transformateurs : L'architecture derrière la plupart des LLM s'appelle un transformateur. Ce modèle utilise des mécanismes d'attention pour évaluer l'importance des différents mots dans une phrase, ce qui lui permet de mieux comprendre le contexte que les modèles précédents.

- Tâches qu'ils effectuent : Une fois formés, les LLM peuvent effectuer diverses tâches linguistiques. Il s'agit notamment de répondre à des questions, de résumer des textes, de traduire des langues, de générer une écriture créative et de coder.

- Modèles populaires: certains LLM bien connus incluent GPT-3, BERT et T5. Ces modèles pré-entraînés peuvent être ajustés pour des tâches spécifiques, ce qui en fait des outils polyvalents pour les développeurs et les chercheurs.

- Applications : les LLM sont utilisés dans les chatbots, les assistants virtuels, la création automatisée de contenu et bien plus encore. Ils contribuent à améliorer les interactions des utilisateurs avec la technologie en permettant aux machines de comprendre et de réagir plus naturellement au langage humain.

Essentiellement, les grands modèles linguistiques sont comme des cerveaux suralimentés pour les ordinateurs, leur permettant de gérer et de générer le langage humain avec une précision et une polyvalence impressionnantes.

CâlinsVisage & LLM

Hugging Face est une entreprise et une plateforme devenue une plaque tournante du traitement du langage naturel (NLP) et de l'apprentissage automatique. Ils fournissent des outils, des bibliothèques et des ressources pour permettre aux développeurs et aux chercheurs de créer et d'utiliser plus facilement des modèles d'apprentissage automatique, en particulier ceux liés à la compréhension et à la génération du langage.

Hugging Face est connu pour ses bibliothèques open source, notamment Transformers , qui offrent un accès facile à une large gamme de modèles de langage pré-entraînés.

Hugging Face héberge de nombreux LLM de pointe comme GPT-3, BERT et T5. Ces modèles sont pré-entraînés sur des ensembles de données massifs et sont prêts à être utilisés pour diverses applications.

La plateforme fournit des API et des outils simples pour intégrer ces modèles dans des applications sans nécessiter une expertise approfondie en apprentissage automatique.

Grâce aux outils de Hugging Face, vous pouvez facilement affiner ces LLM pré-entraînés sur vos propres données, vous permettant ainsi de les adapter à des tâches ou des domaines spécifiques.

Les chercheurs et les développeurs peuvent partager leurs modèles et améliorations sur la plateforme Hugging Face, accélérant ainsi l'innovation et l'application en PNL.

Top 5 des modèles LLM sur Huggingface que vous devriez utiliser

Explorons certains des meilleurs modèles LLM sur Hugging Face qui excellent dans la narration et surpassent même GPT.

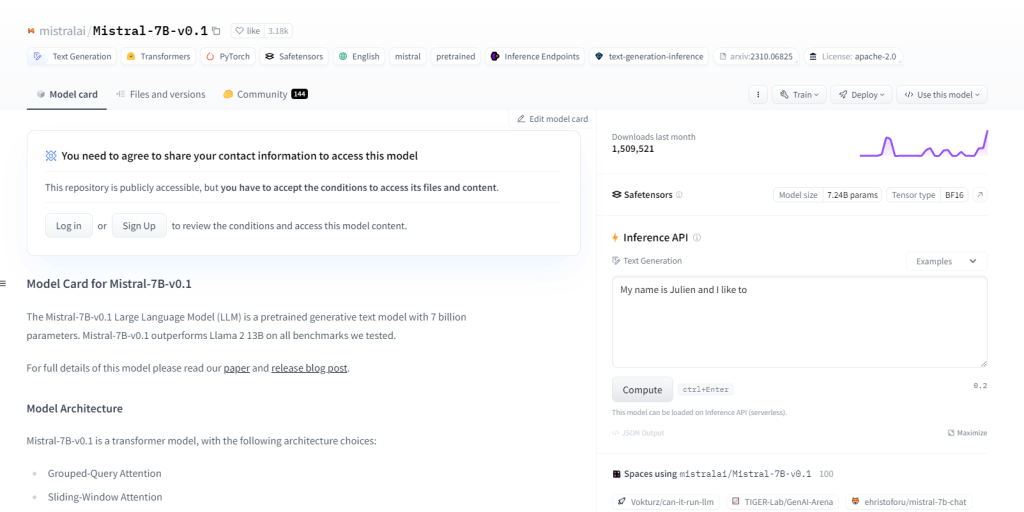

Mistral-7B-v0.1

Le Mistral-7B-v0.1, un modèle LLM (Large Language Model) avec 7 milliards de paramètres, surpasse les benchmarks comme Llama 2 13B dans tous les domaines. Il utilise une architecture de transformateur avec des mécanismes d'attention spécifiques et un tokenizer BPE de secours en octets. Il excelle dans la génération de texte, la compréhension du langage naturel, la traduction linguistique et sert de modèle de base pour la recherche et le développement dans les projets PNL.

Principales caractéristiques

- 7 milliards de paramètres

- Surpasse les références comme Llama 213B

- Architecture du transformateur

- Générateur de jetons BPE

- Développement de projets PNL

- Compréhension du langage naturel

- La traduction de la langue

- Attention aux requêtes groupées

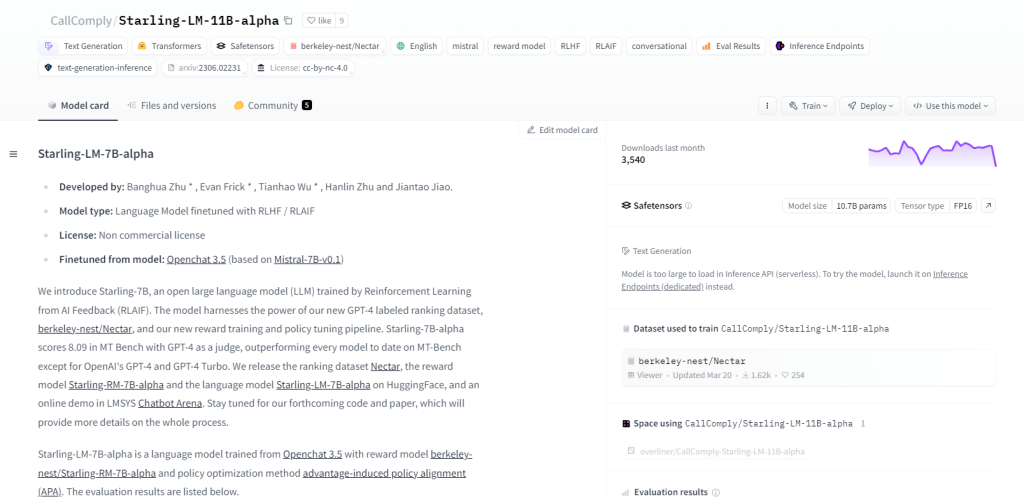

Starling-LM-11B-alpha

Starling-LM-11B-alpha, un grand modèle de langage (LLM) avec 11 milliards de paramètres, émerge de NurtureAI, s'appuyant sur le modèle OpenChat 3.5 comme base. La mise au point est réalisée grâce à l'apprentissage par renforcement à partir des commentaires de l'IA (RLAIF), guidé par des classements étiquetés par des humains. Ce modèle promet de remodeler l'interaction homme-machine grâce à son cadre open source et ses applications polyvalentes, notamment les tâches de PNL, la recherche sur l'apprentissage automatique, l'éducation et la génération de contenu créatif.

Principales caractéristiques

- 11 milliards de paramètres

- Développé par NurtureAI

- Basé sur le modèle OpenChat 3.5

- Affiné grâce au RLAIF

- Classements labellisés par l'homme pour la formation

- Nature open source

- Des capacités diverses

- Utilisation pour la recherche, l'éducation et la génération de contenu créatif

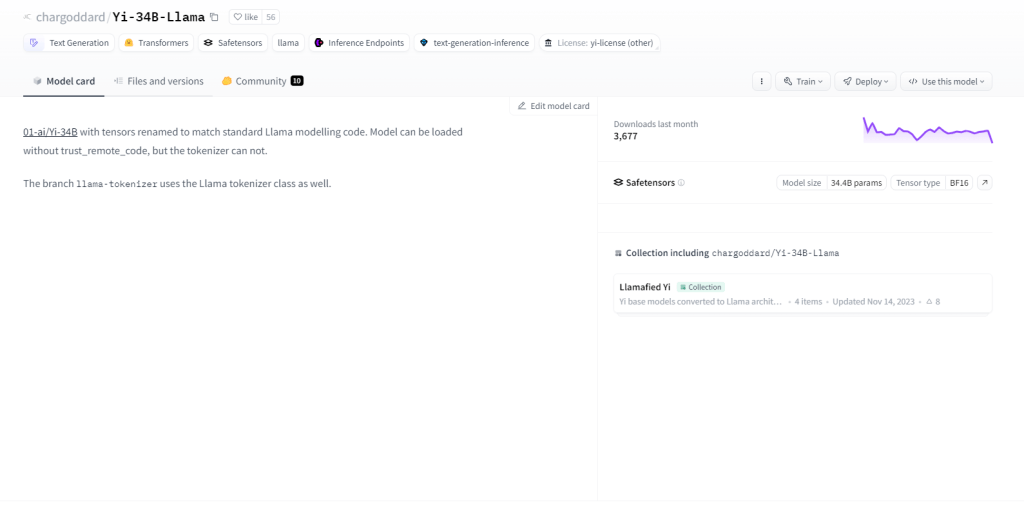

Yi-34B-Lama

Yi-34B-Llama, avec ses 34 milliards de paramètres, présente une capacité d'apprentissage supérieure. Il excelle dans le traitement multimodal, en gérant efficacement le texte, le code et les images. Adoptant l'apprentissage zéro-shot, il s'adapte de manière transparente aux nouvelles tâches. Sa nature dynamique lui permet de mémoriser les interactions passées, améliorant ainsi l'engagement des utilisateurs. Les cas d'utilisation incluent la génération de texte, la traduction automatique, la réponse aux questions, le dialogue, la génération de code et le sous-titrage d'images.

Principales caractéristiques

- 34 milliards de paramètres

- Traitement multimodal

- Capacité d'apprentissage sans tir

- Nature avec état

- Génération de texte

- Traduction automatique

- Réponse aux questions

- Légende des images

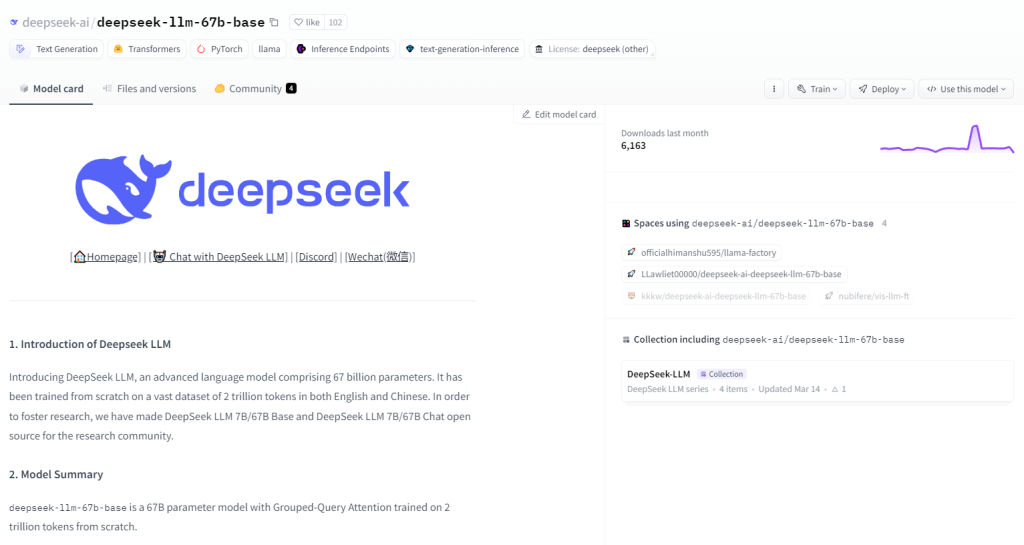

Base DeepSeek LLM 67B

DeepSeek LLM 67B Base, un modèle de langage étendu (LLM) de 67 milliards de paramètres, brille dans les tâches de raisonnement, de codage et de mathématiques. Avec des scores exceptionnels dépassant GPT-3.5 et Llama2 70B Base, il excelle dans la compréhension et la génération de code et démontre des compétences mathématiques remarquables. Son caractère open source sous licence MIT permet une exploration gratuite. Les cas d'utilisation couvrent la programmation, l'éducation, la recherche, la création de contenu, la traduction et la réponse aux questions.

Principales caractéristiques

- Paramètre de 67 milliards

- Performances exceptionnelles en raisonnement, codage et mathématiques

- HumanEval Pass@1 score de 73,78

- Compréhension et génération de code exceptionnelles

- Scores élevés sur GSM8K 0-shot (84,1)

- Surpasse GPT-3.5 en termes de capacités linguistiques

- Open source sous licence MIT

- Excellente capacité de narration et de création de contenu.

Skote - Modèle d'administration et de tableau de bord Svelte

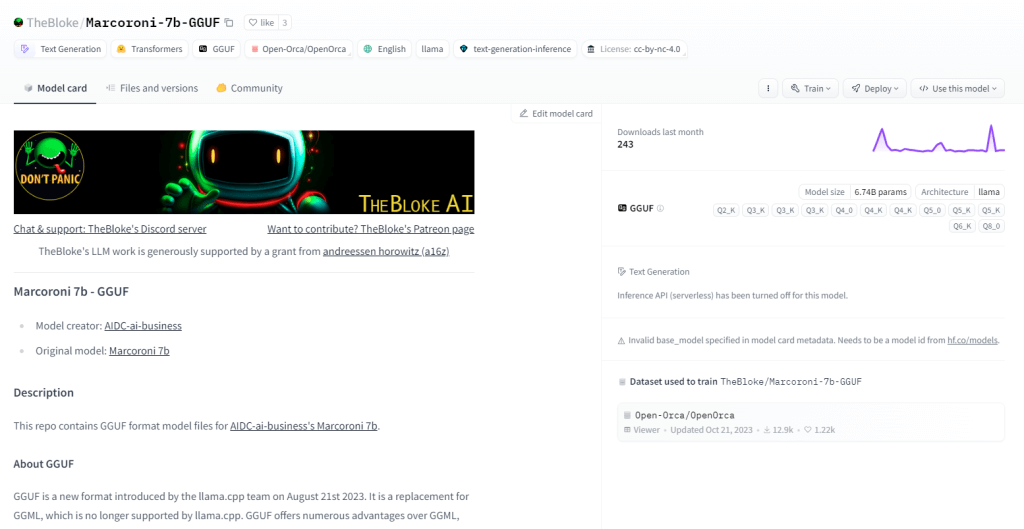

Marcoroni-7B-v3 est un puissant modèle génératif multilingue de 7 milliards de paramètres capable d'effectuer diverses tâches, notamment la génération de texte, la traduction linguistique, la création de contenu créatif et la réponse aux questions. Il excelle dans le traitement du texte et du code, tirant parti de l'apprentissage zéro-shot pour une exécution rapide des tâches sans formation préalable. Open source et sous licence permissive, Marcoroni-7B-v3 facilite une large utilisation et expérimentation.

Principales caractéristiques

- Génération de texte pour des poèmes, du code, des scripts, des e-mails et bien plus encore.

- Traduction automatique de haute précision.

- Création de chatbots engageants avec des conversations naturelles.

- Génération de code à partir de descriptions en langage naturel.

- Capacités complètes de réponse aux questions.

- Résumation de longs textes en résumés concis.

- Paraphrase efficace tout en préservant le sens original.

- Analyse des sentiments pour le contenu textuel.

Emballer

La collection de grands modèles de langage de Hugging Face change la donne pour les développeurs, les chercheurs et les passionnés. Ces modèles jouent un rôle important en repoussant les limites de la compréhension et de la génération du langage naturel, grâce à leurs diverses architectures et capacités. À mesure que la technologie évolue, les applications et l’impact de ces modèles sont infinis. Le voyage d’exploration et d’innovation avec les grands modèles linguistiques est en cours et promet des développements passionnants à venir.