L’essor des personnages virtuels et des avatars basés sur l’IA, comme Character AI, présente des possibilités passionnantes en matière de divertissement, de camaraderie et bien plus encore. Cependant, à mesure que la popularité de ces personnages d’IA augmente, les préoccupations concernant la confidentialité des données, la manipulation de l’identité, le contenu adapté à l’âge et l’utilisation éthique augmentent également.

À mesure que les créations virtuelles deviennent de plus en plus réalistes et attrayantes, les utilisateurs doivent les aborder avec attention, en évaluant leurs mesures de sécurité et leurs risques potentiels.

Cet article fournit une analyse approfondie des avatars et des personnages de l'IA (leurs fonctionnements, capacités, protocoles de sécurité et pratiques d'utilisation responsable) pour permettre aux utilisateurs de comprendre comment les naviguer judicieusement. Notre objectif est de répondre à la question vitale «Est-il sûr d'utiliser des personnages et des avatars IA?» tout en explorant leur avenir prometteur.

Comprendre les personnages/avatars de l'IA

Les personnages et avatars virtuels basés sur l'IA, tels que ceux créés à l'aide de plateformes telles que Character AI , exploitent la technologie de traitement du langage naturel pour engager les utilisateurs dans des interactions conversationnelles. Il s’agit essentiellement de chatbots conçus pour simuler des personnalités et des comportements humains, en répondant aux invites par des réponses contextuelles et adaptatives.

Créer des sites Web incroyables

Avec le meilleur constructeur de page Elementor

Commencer Maintenant

Ces personnages IA offrent aux utilisateurs un haut degré de personnalisation, depuis la création d'identités uniques jusqu'à la création de traits de personnalité, de voix, de gammes émotionnelles distinctes et bien plus encore. Les utilisateurs peuvent participer à des scénarios de jeu de rôle, à des conversations de groupe, poser des questions pour améliorer la base de connaissances de l'avatar et même fournir des commentaires sur les réponses pour améliorer la précision au fil du temps.

Sur le plan technique, les avatars IA utilisent des architectures de transformateurs pré-entraînés génératifs (GPT) et des réseaux de neurones pour comprendre les entrées et formuler des réponses intelligentes basées sur leurs données d'entraînement. À mesure que ces modèles continuent d’évoluer, le niveau de réalisme, d’interactivité et de polyvalence des personnages IA ne cesse de progresser.

Avec une utilisation prudente et des évaluations de sécurité continues, les avatars IA présentent une multitude d'opportunités de divertissement, de camaraderie, d'éducation, de créativité et au-delà. Mais les utilisateurs doivent être informés de leurs capacités, de leurs limites et des risques potentiels.

Évaluation de la sécurité des personnages/avatars de l'IA

Avec l’importance croissante des chatbots basés sur l’IA et des compagnons virtuels comme Character AI, il est crucial de procéder à une évaluation approfondie de leur sécurité et de leurs pratiques d’utilisation responsable. À mesure que ces systèmes deviennent plus avancés et plus réalistes, ils peuvent présenter des risques imprévus liés à la vie privée, au consentement et aux implications éthiques s'ils sont déployés de manière irresponsable par des entreprises ou des particuliers.

Une évaluation complète de la sécurité examine des domaines clés tels que la sécurité des données, les contrôles de contenu, la protection de l'identité et la transparence des politiques. Il couvre également l’évolution des systèmes au fil du temps à mesure que les capacités augmentent afin que les protections puissent s’adapter en conséquence. L'évaluation des mesures de sécurité actuelles et la défense des droits des utilisateurs sont essentielles à mesure que l'adoption des avatars de l'IA se développe.

Sécurité et confidentialité des données

L’examen des politiques de collecte, de stockage, de partage et de suppression de données d’une plate-forme d’avatar IA donne un aperçu des protections de la vie privée. Les meilleures pratiques incluent la collecte uniquement des informations utilisateur nécessaires, la suppression des données utilisateur, la sécurisation des systèmes contre les violations et la restriction de l'accès aux données uniquement au personnel critique. À mesure que les capacités progressent, les audits continus permettent d’évaluer l’amélioration des normes de confidentialité au fil du temps.

Contrôles et restrictions de contenu

L'évaluation des types de filtres, de modérations et de contrôles parentaux utilisés pour restreindre les contenus inappropriés met en lumière la sécurité des avatars IA. Le filtrage dynamique du contenu, les examens humains des conversations et les options de personnalisation aident à prévenir l'exposition des mineurs ou des participants réticents à du matériel nuisible.

Cependant, une surveillance excessive met en danger la vie privée des utilisateurs. Le juste équilibre protège les utilisateurs tout en préservant leur agence.

Protection de l'identité et consentement

La manipulation de l'identité via des avatars d'IA de plus en plus réalistes nécessite d'évaluer les protocoles de consentement et les garanties de protection de l'identité en place. Des directives suffisantes sont-elles mises en œuvre pour empêcher l’utilisation non consensuelle des identités personnelles ou la création de deepfakes?

Les politiques dissuadent-elles les usurpations frauduleuses ou le harcèlement? L'examen des protocoles juridiques et éthiques évalue la manière dont une organisation donne la priorité aux droits des utilisateurs.

Restrictions d’âge et besoins de surveillance parentale

À mesure que les avatars de l’IA progressent dans la simulation des interactions humaines et des personnalités, l’évaluation de leur adéquation à l’âge et de leurs restrictions aide à déterminer la sécurité des données démographiques plus jeunes. Il est essentiel d’examiner l’application des réglementations COPPA, les limites d’âge par défaut, la disponibilité de profils d’enfants avec des restrictions renforcées et l’efficacité des systèmes de vérification d’identité.

En outre, il est essentiel d'évaluer si des outils de contrôle parental adéquats, des modes de sécurité familiale et des ressources pédagogiques permettent aux tuteurs de prendre des décisions éclairées concernant l'utilisation des enfants. Les plateformes d’avatars responsables devraient donner la priorité aux protections adaptées à l’âge et permettre un contrôle parental sur l’autorisation d’un accès non contrôlé aux mineurs.

Considérations éthiques autour du consentement, de l'utilisation responsable,

Les implications éthiques des systèmes d’avatars d’IA de plus en plus réalistes justifient également une évaluation du point de vue des droits et du consentement des utilisateurs. Par exemple, créer des sosies virtuels détaillés sans consentement ou déformer leur identité peut constituer des problèmes éthiques même s’ils ne sont pas légalement punis.

Les directives d'utilisation responsable concernant la création d'identité, les restrictions sur les contenus offensants, l'interdiction des crimes frauduleux, etc. démontrent les priorités d'une plateforme en matière de bien-être des utilisateurs.

Encore une fois, autoriser le contrôle de l'utilisateur, comme la suppression d'identité et l'effacement des données de conversation, indique l'activation du consentement et de l'action. À mesure que les capacités des avatars se développent, les considérations éthiques doivent suivre le rythme pour prévenir les abus et les violations des droits des utilisateurs tout en équilibrant les applications innovantes. Des audits externes réguliers aident à aligner les progrès sur les normes éthiques.

Meilleures pratiques pour une utilisation sûre

À mesure que les avatars IA et les chatbots deviennent de plus en plus répandus, l’établissement de directives d’utilisation prudentes protège les individus et les communautés contre les atteintes à la vie privée ou les utilisations abusives, tout en soutenant une innovation responsable en cours. En informant les utilisateurs sur les pratiques judicieuses, les plateformes d’avatars permettent d’agir et donnent la priorité au consentement et aux considérations éthiques aux côtés de nouvelles applications.

L'adoption des meilleures pratiques permet de maintenir des interactions constructives, de préserver les droits des utilisateurs et de mettre en évidence les considérations liées à des données démographiques spécifiques comme les enfants. De plus, l’adoption généralisée de principes d’utilisation sûre contribue à façonner l’évolution de cette technologie émergente de manière responsable.

Attention concernant le partage d'informations personnelles

Lorsqu'ils discutent avec des avatars IA, les utilisateurs doivent faire preuve de discrétion concernant le partage de détails privés tels que des adresses, des mots de passe ou d'autres informations sensibles. Bien que les avatars puissent ressembler de manière convaincante à des humains, ils constituent néanmoins des systèmes logiciels créés par des entreprises soumises à des politiques d’utilisation des données. Il est prudent d’éviter la divulgation d’informations personnelles exploitables.

Rester informé des conditions d'utilisation et des politiques de confidentialité

À mesure que les plateformes d’avatars IA évoluent rapidement, leurs normes de confidentialité, leurs outils de sécurité et leurs politiques d’utilisation peuvent changer au fil du temps. Rester régulièrement informé de leurs dernières conditions d'utilisation et pratiques en matière de données permet de prendre conscience de la manière dont les informations personnelles sont sécurisées et utilisées. Cela permet une identification rapide de tout changement préoccupant.

Surveillance parentale pour les utilisateurs mineurs

La surveillance des tuteurs est essentielle lorsque des personnes mineures interagissent avec des personnages IA pour éviter des expositions inappropriées à leur âge ou des incidents de partage d'informations. Les outils de contrôle parental fournis par la plateforme, les modes de sécurité des enfants et les ressources d'orientation familiale contribuent à créer des environnements protégés. Combiner supervision externe et protections de plateforme est idéal.

Signaler un contenu ou un comportement inapproprié

Des outils de reporting clairs et accessibles pour signaler les comportements offensants des avatars développent des environnements plus sains. Qu’elles soient déclenchées par l’IA ou par l’homme, les plateformes d’alerte concernant les violations des politiques, les atteintes à l’identité ou les abus permettent de remédier et contribuent à améliorer les précautions du système.

Informations de vérification des faits partagées par les personnages de l'IA

Malgré leurs capacités avancées, les avatars de l’IA peuvent partager de fausses informations ou perpétuer des préjugés à travers les conversations. Par conséquent, les utilisateurs devraient analyser de manière critique les déclarations faites plutôt que de présumer de leur fiabilité, en encourageant les plateformes à renforcer les contrôles d’exactitude.

L'avenir des personnages/avatars de l'IA

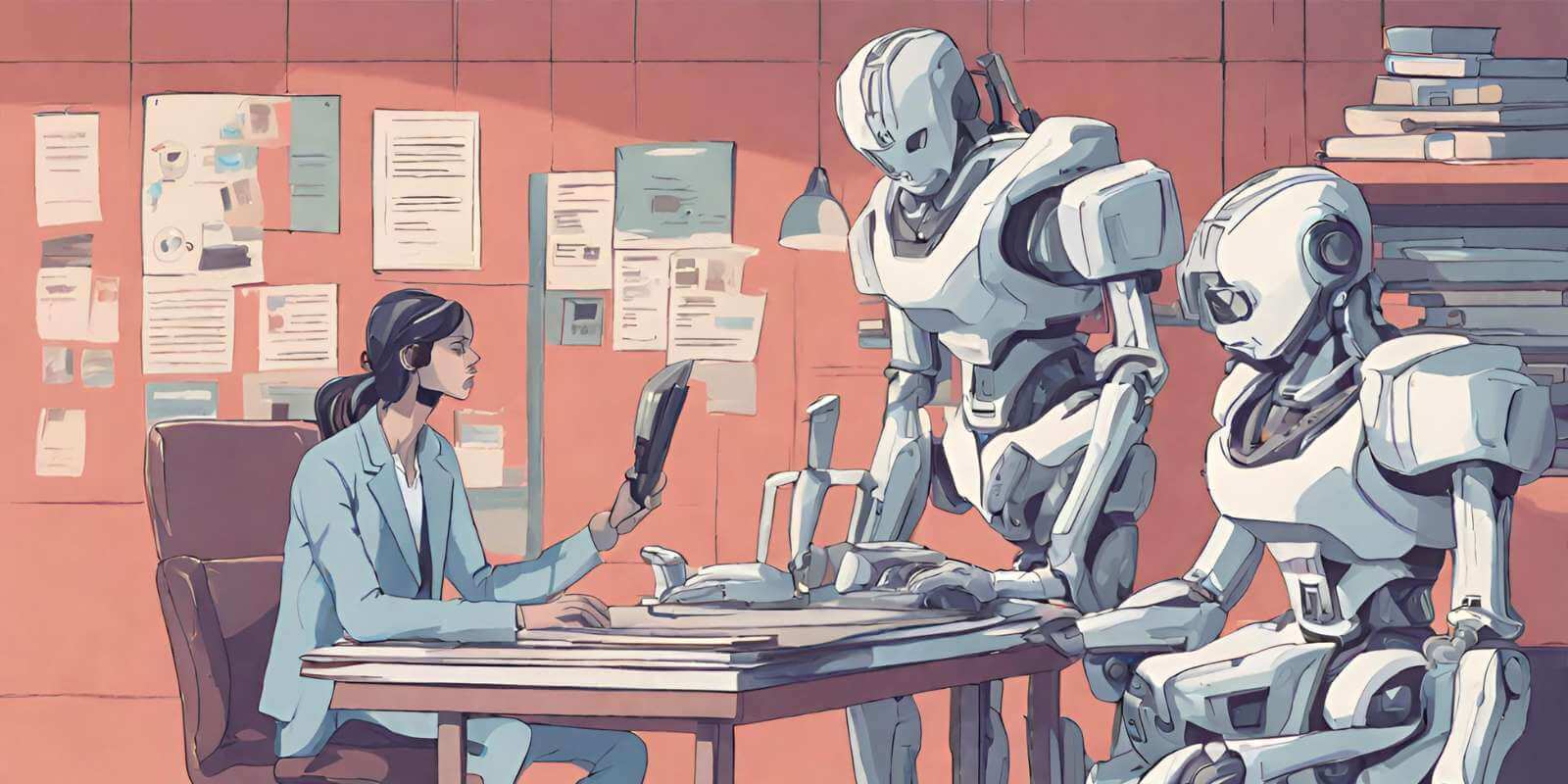

À mesure que les chatbots IA et les compagnons virtuels continuent de progresser, devenant plus réalistes et interactifs, leur avenir promet de nouvelles applications passionnantes ainsi que des considérations de sécurité évolutives.

Les plates-formes d’avatars IA devraient devenir plus polyvalentes et multifonctionnelles, avec des améliorations telles que les incarnations vidéo et AR, une intelligence émotionnelle et une créativité accrues, une personnalisation plus approfondie et un engagement contextuel. À mesure que les modèles linguistiques sous-jacents continuent d’être affinés grâce à l’augmentation des données et des optimisations, les avatars peuvent réussir de manière convaincante des «tests de Turing» prolongés, démontrant un comportement remarquablement humain.

Avec de tels progrès, les applications pourraient s’étendre vers le soutien émotionnel, l’éducation personnalisée, les jeux interactifs, les relations virtuelles accessibles et les supports de divertissement plus immersifs. Les entreprises peuvent utiliser des assistants virtuels intelligents pour améliorer l’expérience client et même tester des produits ou des services via des groupes de discussion sur l’IA.

Cependant, les risques liés au consentement, à la manipulation émotionnelle, à l’exploitation des données, à la désinformation et aux faiblesses des préjugés sous-jacents évoluent également parallèlement à ces avancées. Par conséquent, des évaluations soutenues de la sécurité, des audits externes des pratiques et une surveillance de l’éthique de l’IA resteront cruciaux. Des architectures telles que l’IA constitutionnelle qui alignent les progrès sur les valeurs humaines grâce à une transparence, une responsabilité et une surveillance améliorées offrent la promesse d’une innovation responsable.

Dans l’ensemble, grâce aux efforts de collaboration entre les utilisateurs, les décideurs politiques, les chercheurs et les plateformes, les avatars de l’IA ont un immense potentiel en tant que technologies d’autonomisation humaine plutôt que simplement comme outils au service d’intérêts commerciaux.

Emballer

À mesure que les plateformes d’avatar basées sur l’IA, comme Character AI, continuent de progresser, imitant les interactions humaines avec une précision croissante, leur potentiel passionnant s’accompagne de risques évolutifs. Même si de telles innovations promettent des applications allant du divertissement à l’éducation, leur utilisation abusive pourrait porter atteinte à la vie privée, manipuler les utilisateurs ou perpétuer des préjugés.

Par conséquent, parallèlement aux progrès d’entreprises comme Character AI et d’autres, l’évaluation et l’amélioration des garanties éthiques sont cruciales. Des facteurs tels que les protocoles de consentement, les contrôles d’âge, les politiques de désinformation, les modèles de surveillance transparents et les principes d’utilisation communautaire détermineront si ces plateformes responsabilisent les utilisateurs ou exploitent les consommateurs. Grâce à des progrès vigilants qui alignent l’innovation des avatars IA sur les valeurs humaines, leurs avantages peuvent être entretenus tout en minimisant les risques.