El auge de personajes y avatares virtuales impulsados por IA, como Character AI, presenta interesantes posibilidades de entretenimiento, compañerismo y más. Sin embargo, a medida que crece la popularidad de estas personas de IA, también aumentan las preocupaciones sobre la privacidad de los datos, la manipulación de la identidad, el contenido apropiado para la edad y el uso ético.

A medida que las creaciones virtuales se vuelven cada vez más realistas y atractivas, los usuarios deben abordarlas con atención, evaluando sus medidas de seguridad y sus riesgos potenciales.

Este artículo proporciona un análisis en profundidad de los avatares y personajes de la IA (su funcionamiento, capacidades, protocolos de seguridad y prácticas de uso responsable) para capacitar a los usuarios para que comprendan cómo navegar por ellos con prudencia. Nuestro objetivo es responder a la pregunta vital "¿Es seguro utilizar personajes y avatares de IA?" mientras exploran su prometedor futuro.

Comprender los personajes/avatares de IA

Los personajes y avatares virtuales impulsados por IA, como los creados utilizando plataformas como Character AI , aprovechan la tecnología de procesamiento del lenguaje natural para involucrar a los usuarios en interacciones conversacionales. Básicamente, son chatbots diseñados para simular personalidades y comportamientos humanos, respondiendo a indicaciones con respuestas contextuales y adaptativas.

Create Amazing Websites

Con el mejor generador de páginas gratuito Elementor

Empezar ahora

Estos personajes de IA permiten a los usuarios un alto grado de personalización, desde la creación de identidades únicas hasta la configuración de distintos rasgos de personalidad, voces, rangos emocionales y más. Los usuarios pueden participar en escenarios de juegos de rol, conversaciones grupales, hacer preguntas para mejorar la base de conocimientos del avatar e incluso proporcionar comentarios sobre las respuestas para mejorar la precisión con el tiempo.

A nivel técnico, los avatares de IA utilizan arquitecturas de transformadores generativos preentrenados (GPT) y redes neuronales para comprender las entradas y formular respuestas inteligentes basadas en sus datos de entrenamiento. A medida que estos modelos continúan evolucionando, el nivel de realismo, interactividad y versatilidad de los personajes de IA sigue avanzando.

Con un uso cuidadoso y evaluaciones de seguridad continuas, los avatares de IA presentan una gran cantidad de oportunidades de entretenimiento, compañerismo, educación, creatividad y más. Pero los usuarios deben estar informados sobre sus capacidades, limitaciones y riesgos potenciales.

Evaluación de la seguridad de los personajes/avatares de IA

Con la creciente importancia de los chatbots impulsados por IA y los compañeros virtuales como Character AI, es crucial realizar una evaluación sólida de su seguridad y prácticas de uso responsable. A medida que estos sistemas se vuelven más avanzados y realistas, pueden plantear riesgos imprevistos relacionados con la privacidad, el consentimiento y las implicaciones éticas si las empresas o los individuos los implementan de manera irresponsable.

Una evaluación de seguridad integral examina áreas clave como la seguridad de los datos, los controles de contenido, la protección de la identidad y la transparencia de las políticas. También cubre la evolución de los sistemas a lo largo del tiempo a medida que las capacidades se expanden para que las protecciones puedan adaptarse en consecuencia. Evaluar las medidas de seguridad actuales y defender los derechos de los usuarios es vital a medida que crece la adopción de avatares de IA.

Seguridad y privacidad de los datos

Examinar las políticas de recopilación, almacenamiento, intercambio y eliminación de datos de una plataforma de avatar de IA proporciona información sobre las protecciones de privacidad. Las mejores prácticas incluyen recopilar solo la información necesaria del usuario, permitir la eliminación de datos del usuario, proteger los sistemas contra violaciones y restringir el acceso a los datos solo al personal crítico. A medida que avanzan las capacidades, las auditorías continuas ayudan a evaluar la mejora de los estándares de privacidad a lo largo del tiempo.

Controles y restricciones de contenido

La evaluación de los tipos de filtros, moderaciones y controles parentales utilizados para restringir el contenido inapropiado arroja luz sobre la seguridad de los avatares de IA. La detección dinámica de contenido, las revisiones humanas de las conversaciones y las opciones de personalización ayudan a prevenir la exposición de menores o participantes involuntarios a material dañino.

Sin embargo, una vigilancia excesiva pone en riesgo la privacidad del usuario. El equilibrio adecuado protege a los usuarios y al mismo tiempo preserva su agencia.

Protección de identidad y consentimiento

La manipulación de la identidad a través de avatares de IA cada vez más realistas requiere evaluar los protocolos de consentimiento y las salvaguardias de protección de la identidad vigentes. ¿Se implementan pautas suficientes para evitar el uso no consensuado de identidades personales o la creación de deepfakes?

¿Las políticas disuaden a las personas fraudulentas o al acoso? El examen de los protocolos legales y éticos evalúa cómo una organización prioriza los derechos de los usuarios.

Restricciones de edad y necesidades de orientación de los padres

A medida que los avatares de IA avanzan en la simulación de interacciones y personalidades humanas, evaluar su idoneidad y restricciones para la edad ayuda a determinar la seguridad para los grupos demográficos más jóvenes. Es vital examinar la aplicación de las regulaciones COPPA, las limitaciones de edad predeterminadas, la disponibilidad de perfiles infantiles con mayores restricciones y la eficacia de los sistemas de verificación de identidad.

Además, es clave evaluar si las herramientas adecuadas de control parental, los modos de seguridad familiar y los recursos educativos permiten a los tutores tomar decisiones informadas sobre el uso de los niños. Las plataformas de avatar responsables deben priorizar las protecciones apropiadas para la edad y permitir la supervisión de los padres en lugar de permitir el acceso no controlado a menores.

Consideraciones éticas en torno al consentimiento, uso responsable,

Las implicaciones éticas de los sistemas de avatares de IA cada vez más realistas también justifican una evaluación desde la perspectiva de los derechos y el consentimiento del usuario. Por ejemplo, crear dobles virtuales detallados sin consentimiento o tergiversar identidades puede constituir cuestiones éticas incluso si no es legalmente punible.

Las pautas de uso responsable en materia de creación de identidad, restricciones de contenido ofensivo, prohibiciones de delitos fraudulentos, etc. demuestran las prioridades de una plataforma en cuanto al bienestar del usuario.

Nuevamente, permitir el control del usuario, como la eliminación de identidad y el borrado de datos de conversaciones, indica permitir el consentimiento y la agencia. A medida que crecen las capacidades de los avatares, las consideraciones éticas deben seguir el ritmo para evitar el uso indebido y las violaciones de los derechos de los usuarios y, al mismo tiempo, equilibrar las aplicaciones innovadoras. Las auditorías externas periódicas ayudan a alinear los avances con los estándares éticos.

Mejores prácticas para un uso seguro

A medida que los avatares de IA y los chatbots se vuelven más prominentes, el establecimiento de pautas de uso prudentes protege a las personas y las comunidades de la infracción o el uso indebido de la privacidad, al tiempo que apoya la innovación responsable continua. Al informar a los usuarios sobre prácticas sensatas, las plataformas de avatar permiten la agencia y priorizan el consentimiento y las consideraciones éticas junto con aplicaciones novedosas.

La adopción de mejores prácticas ayuda a mantener interacciones constructivas, preserva los derechos de los usuarios y resalta consideraciones para grupos demográficos específicos, como los niños. Además, la adopción generalizada de principios de uso seguro ayuda a dar forma responsable a la evolución de esta tecnología emergente.

Precaución al compartir información personal

Al conversar con avatares de IA, los usuarios deben actuar con discreción a la hora de compartir detalles privados como direcciones, contraseñas u otra información confidencial. Si bien los avatares pueden parecer convincentemente humanos, siguen constituyendo sistemas de software creados por empresas sujetas a políticas de utilización de datos. Es prudente evitar la divulgación de información personal explotable.

Mantenerse actualizado sobre los términos de servicio y las políticas de privacidad

A medida que las plataformas de avatares de IA crecen rápidamente, sus estándares de privacidad, herramientas de seguridad y políticas de usuario pueden cambiar con el tiempo. Mantenerse informado periódicamente sobre sus últimos términos de servicio y prácticas de datos brinda conocimiento sobre cómo se protege y utiliza la información personal. Esto permite una rápida identificación de cualquier cambio preocupante.

Supervisión parental para usuarios menores de edad

La supervisión del tutor es clave mientras los menores de edad interactúan con personas de IA para evitar exposiciones inapropiadas para su edad o incidentes de intercambio de información. Las herramientas de control parental, los modos de seguridad infantil y los recursos de orientación familiar proporcionados por la plataforma ayudan a habilitar entornos protegidos. Lo ideal es combinar supervisión externa y protecciones de plataforma.

Informar contenido o comportamiento inapropiado

Las herramientas de informes claras y accesibles para señalar comportamientos ofensivos de avatares desarrollan entornos más saludables. Ya sea mediante IA o activadas por humanos, las plataformas de alerta sobre violaciones de políticas, infracción de identidad o abuso permiten la reparación y ayudan a mejorar las precauciones del sistema.

Información de verificación de hechos compartida por personajes de IA

A pesar de las capacidades avanzadas, los avatares de IA pueden compartir información falsa o perpetuar prejuicios a través de conversaciones. Por lo tanto, los usuarios deberían analizar críticamente las declaraciones hechas en lugar de asumir confiabilidad, alentando a las plataformas a aumentar los controles de precisión.

El futuro de los personajes/avatares de IA

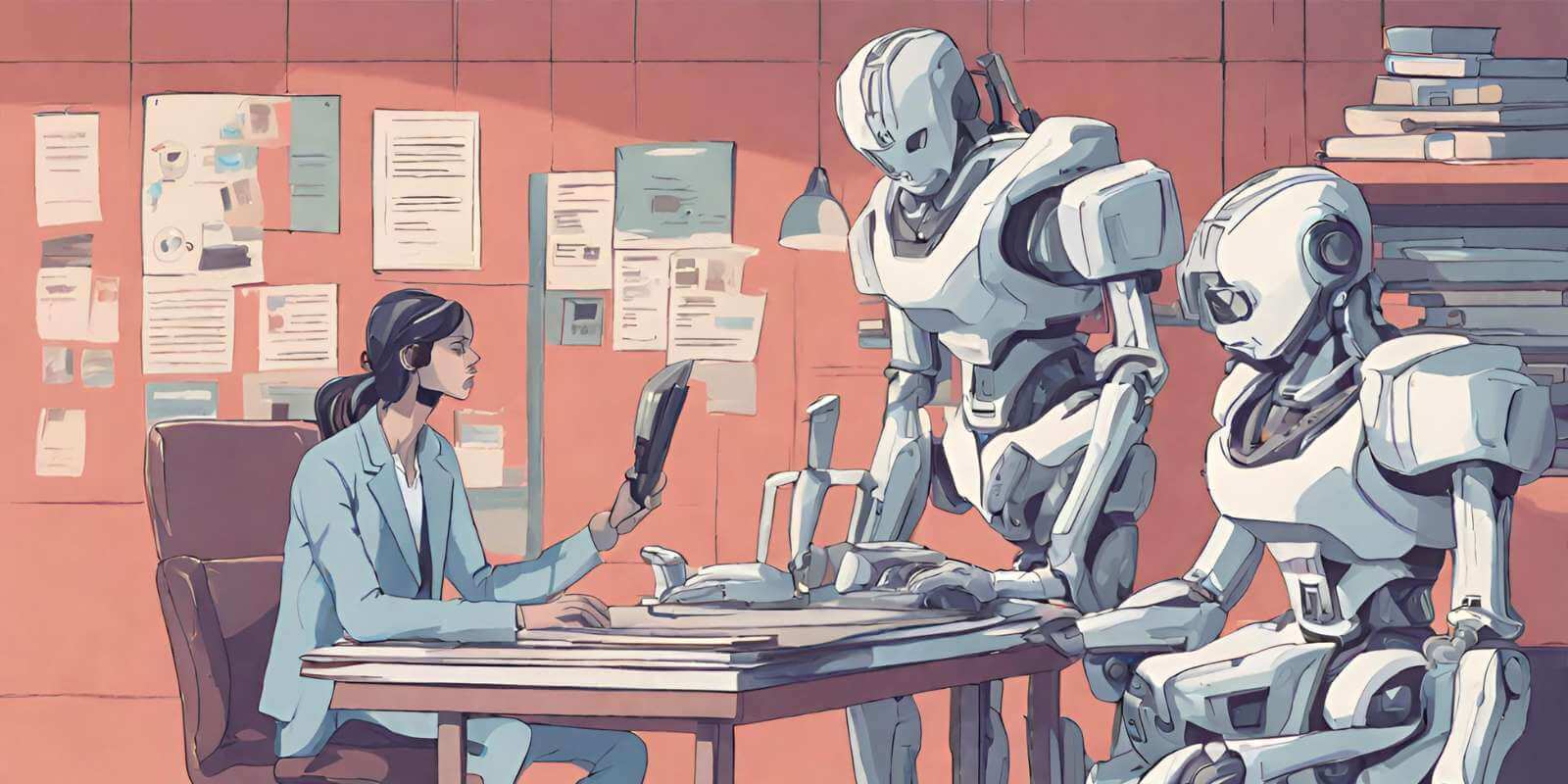

A medida que los chatbots de IA y los compañeros virtuales continúan avanzando, volviéndose más realistas e interactivos, su futuro promete nuevas aplicaciones interesantes junto con consideraciones de seguridad en evolución.

Se prevé que las plataformas de avatar de IA se vuelvan más versátiles y multifuncionales, con mejoras como video y encarnaciones de AR, inteligencia emocional y creatividad ampliadas, una personalización más profunda y un compromiso contextual. A medida que los modelos de lenguaje subyacentes continúan perfeccionándose a través de mayores datos y optimizaciones, los avatares pueden pasar de manera convincente "pruebas de Turing" prolongadas que exhiben un comportamiento notablemente humano.

Con tal progreso, las aplicaciones podrían expandirse hacia el apoyo emocional, la educación personalizada, los juegos interactivos, las relaciones virtuales accesibles y medios de entretenimiento más inmersivos. Las empresas pueden emplear asistentes virtuales inteligentes para mejorar las experiencias de los clientes e incluso probar productos o servicios a través de grupos focales de IA.

Sin embargo, los riesgos relacionados con el consentimiento, la manipulación emocional, la explotación de datos, la desinformación y las debilidades de los prejuicios subyacentes también aumentan junto con estos avances. Por lo tanto, las evaluaciones de seguridad sostenidas, las auditorías externas de las prácticas y la supervisión ética de la IA seguirán siendo cruciales. Arquitecturas como la IA constitucional, que alinean los avances con los valores humanos a través de una mayor transparencia, rendición de cuentas y supervisión, son prometedoras para la innovación responsable.

En general, con esfuerzos de colaboración entre usuarios, formuladores de políticas, investigadores y plataformas, los avatares de IA tienen un inmenso potencial como tecnologías de empoderamiento humano en lugar de simplemente herramientas para intereses comerciales.

Terminando

A medida que las plataformas de avatar impulsadas por IA, como Character AI, continúan avanzando, imitando las interacciones humanas con cada vez más precisión, su apasionante potencial se entrelaza con riesgos en evolución. Aunque estas innovaciones prometen aplicaciones que van desde el entretenimiento hasta la educación, su uso indebido podría infringir la privacidad, manipular a los usuarios o perpetuar los prejuicios.

Por lo tanto, junto con el progreso de empresas como Character AI y otras, evaluar y mejorar las salvaguardias éticas es crucial. Factores como los protocolos de consentimiento, los controles de edad, las políticas de desinformación, los modelos de supervisión transparentes y los principios de uso comunitario determinarán si estas plataformas empoderan a los usuarios o explotan a los consumidores. A través de un avance atento que alinee la innovación de los avatares de IA con los valores humanos, se pueden fomentar sus beneficios mientras se minimizan los riesgos.